senet专题

iTransformer时序模型改进——基于SENet和TCN的倒置Transformer,性能暴涨

1数据集介绍 ETT(电变压器温度):由两个小时级数据集(ETTh)和两个 15 分钟级数据集(ETTm)组成。它们中的每一个都包含 2016 年 7 月至 2018 年 7 月的七种石油和电力变压器的负载特征。 数据集链接: https://drive.google.com/drive/folders/1ZOYpTUa82_jCcxIdTmyr0LXQfvaM9vIy 参

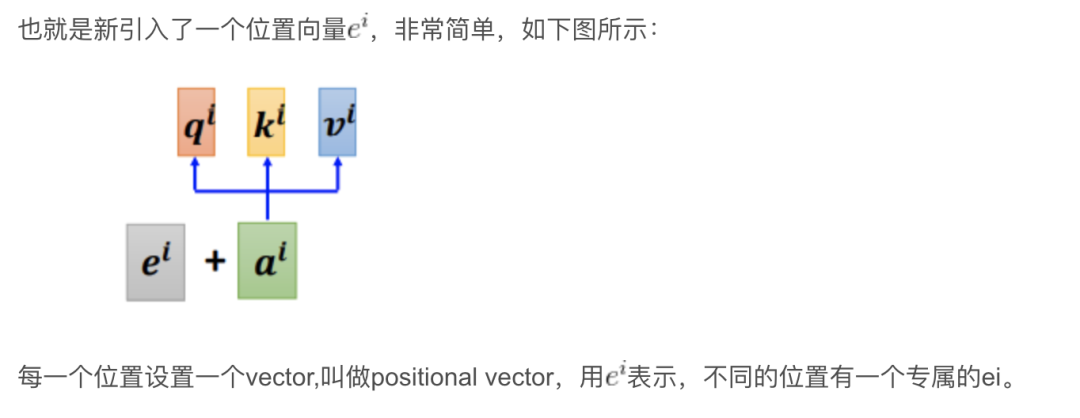

TransFormer学习之基础知识:STN、SENet、CBAM、Self-Attention

1.空间注意力机制STN 参考链接:STN(Spatial Transformer Networks) 参考链接:通俗易懂的Spatial Transformer Networks(STN) 核心动机: 在空间中捕获重要区域特征(如图像中的数字),将核心区域进行放大居中,使得结果更容易识别主体结构: 局部网络、参数化网络采样(网络生成器)和差分图像采样 1.1 局部网络(Localisat

注意力机制:SENet详解

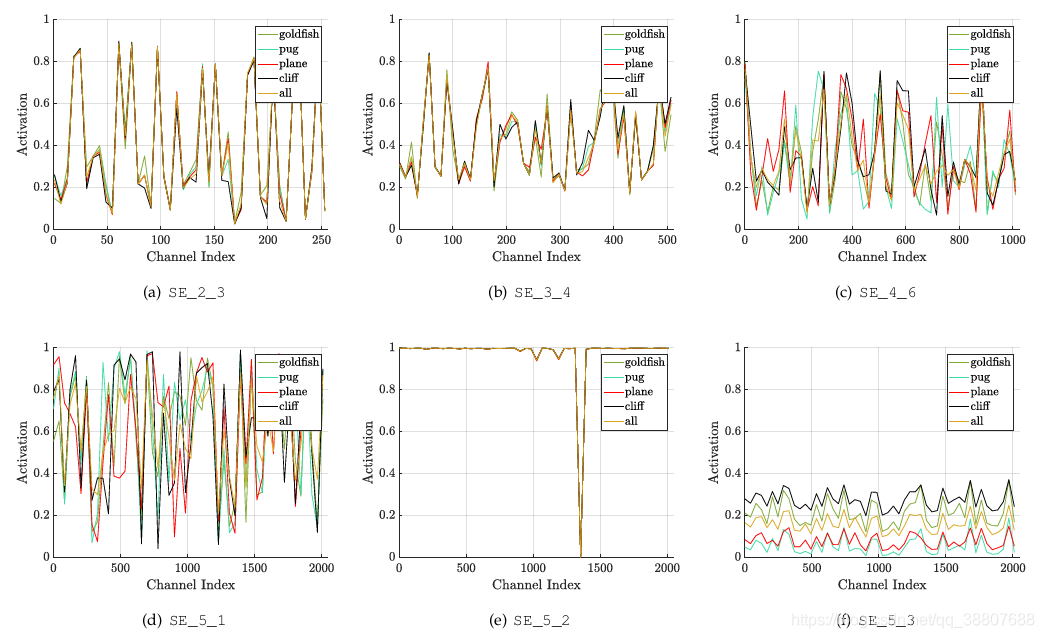

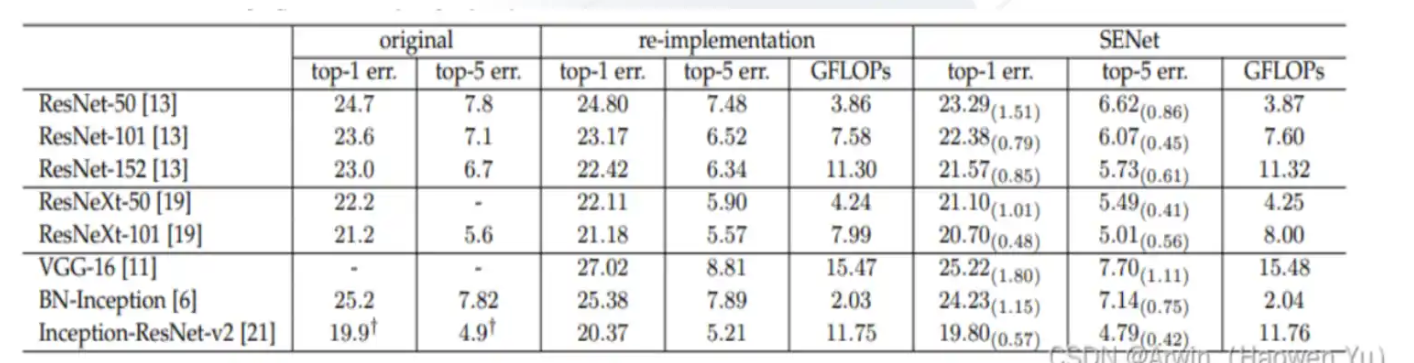

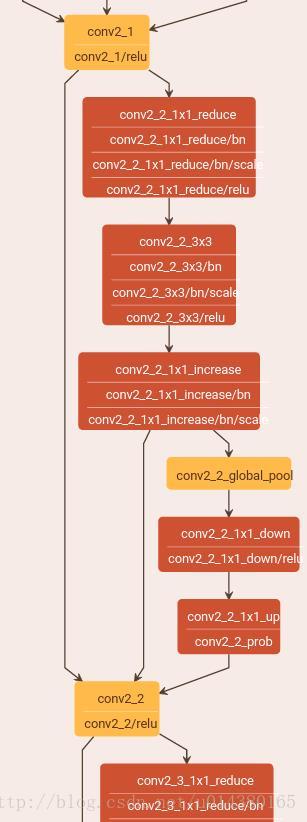

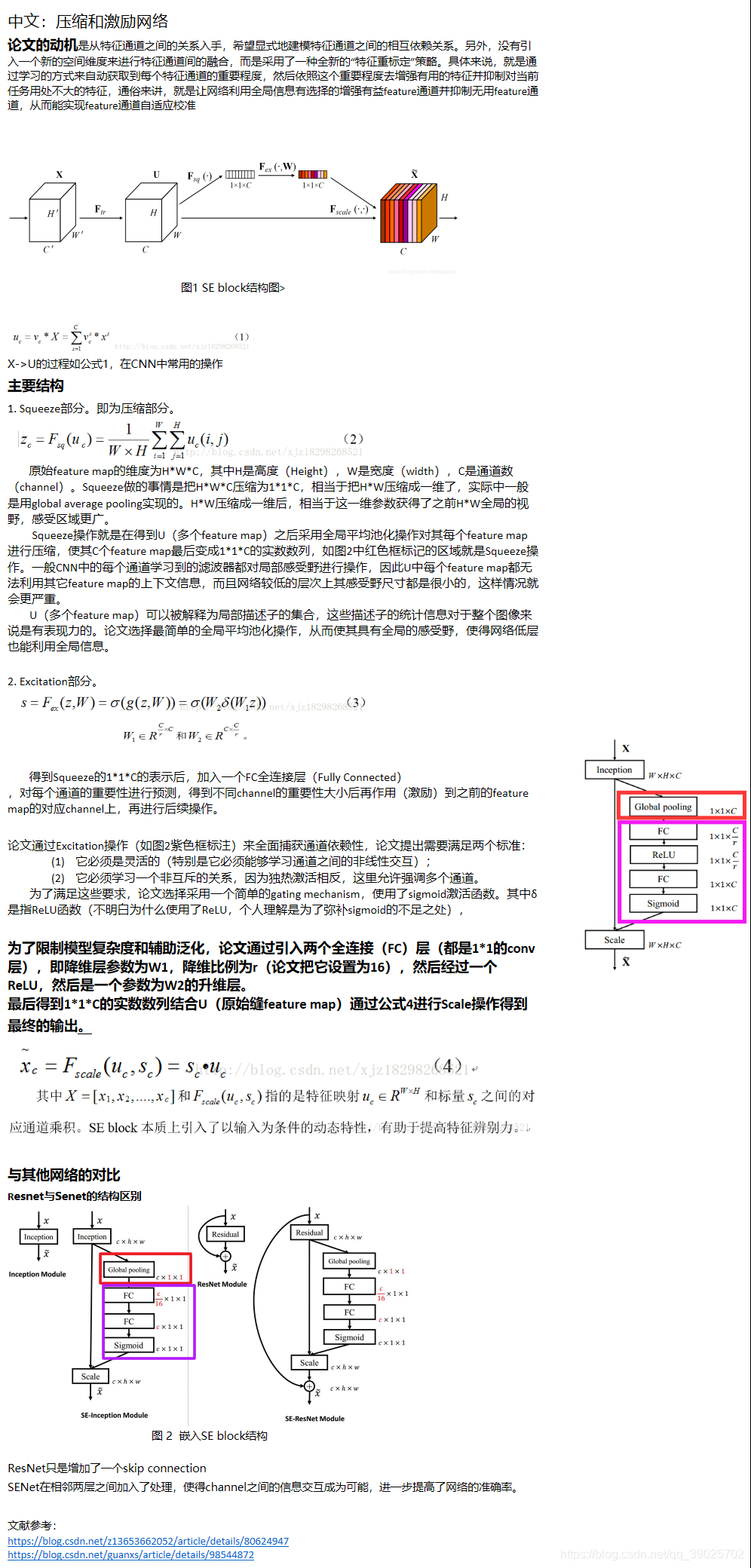

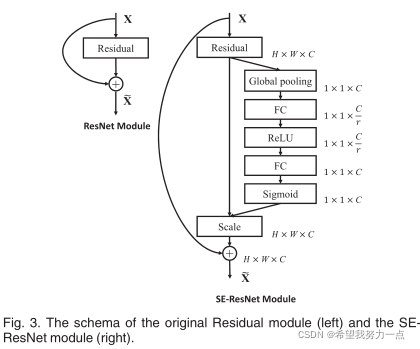

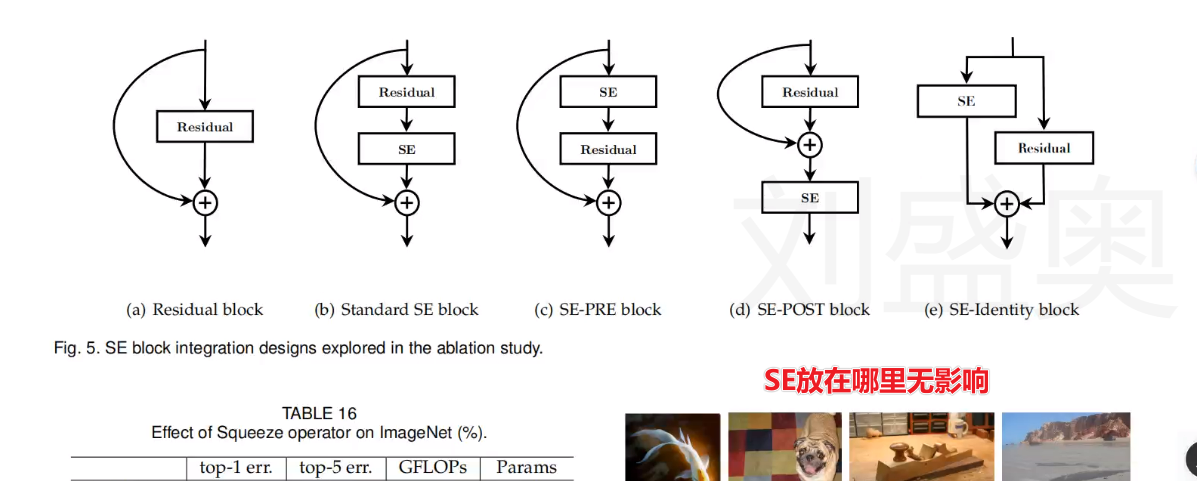

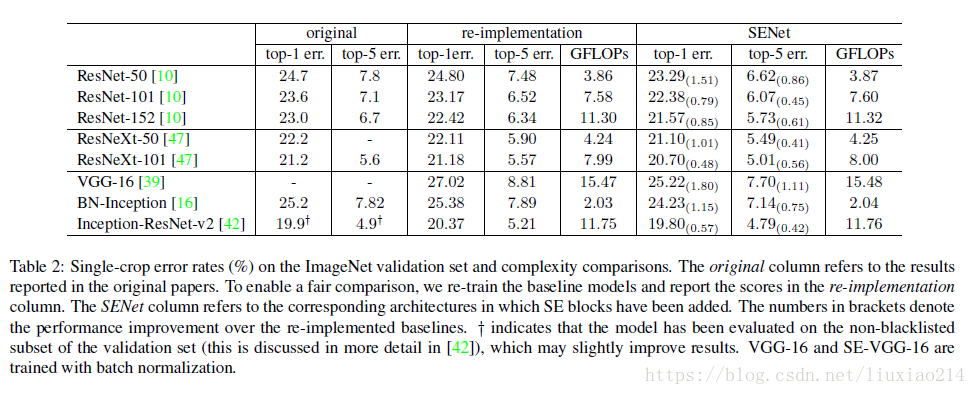

SENet(Squeeze-and-Excitation Networks)是2017年提出的一种经典的通道注意力机制,这种注意力可以让网络更加专注于一些重要的featuremap,它通过对特征通道间的相关性进行建模,把重要的特征图进行强化来提升模型的性能。论文链接 代码实现 模型 SENet的模型结果如图所示: 网络的输入 X X X是个多通道的图片,其维度为 [ H ′ ,

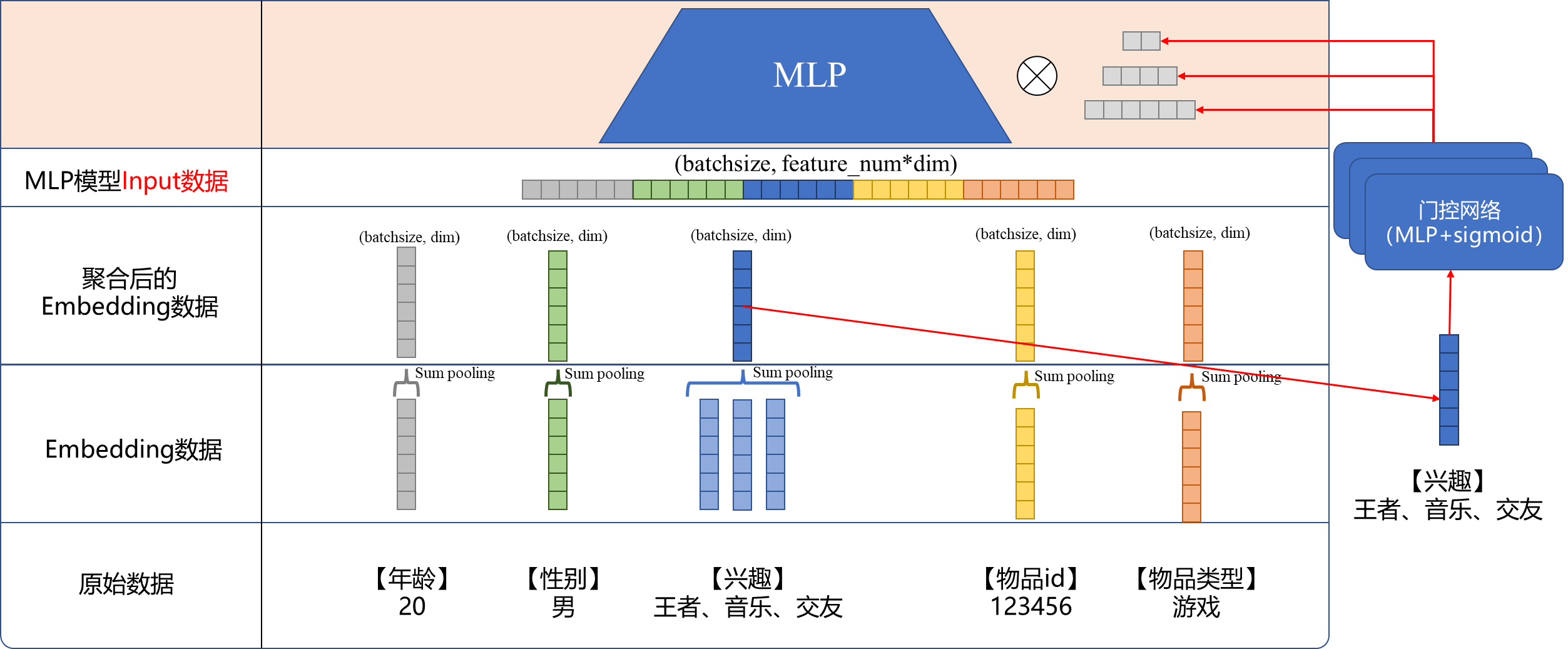

DIN特征加权、POSO特征增强、SENET特征选择

本文转自:DIN、POSO、SENet 聊聊推荐模型中常用的Attention-腾讯云开发者社区-腾讯云 一、前言 聊起模型结构的时候,经常听做推荐的同学说: "这里加了个self-attention" "类似于一个SENet" "一个魔改的POSO" "DIN就是一个attention" ...... 这些常见的模块、模型,听完之后很多时候还是一知半解,看了几篇模型的知乎,感觉长得

[总结] SEnet

SENet (压缩激励网络) SENet是Squeeze-and-Excitation Networks的简称,拿到了ImageNet2017分类比赛冠军。 其中SE模块 简单可嵌入。 SENet可以看作attention的思想,学习了channel之间的注意力分布。

41_经典卷积网络、LeNet、AlexNet、VGG、GoogleNet、ResNet、NIN、DenseNet、EfficientNet、MobileNetV1/2/3、SENet等

1.38.经典卷积网络 1.38.1.LeNet 1.38.1.1.介绍 1.38.1.2.网络结构 1.38.1.3.代码实现 1.38.2.AlexNet 1.38.2.1.介绍 1.38.2.2.网络结构 1.38.2.3.代码实现 1.38.3.VGG 1.38.3.1.介绍 1.38.3.2.网络结构 VGG-16 1.38.3.3.代码实现 1.38.4.GoogleNet 1.38.

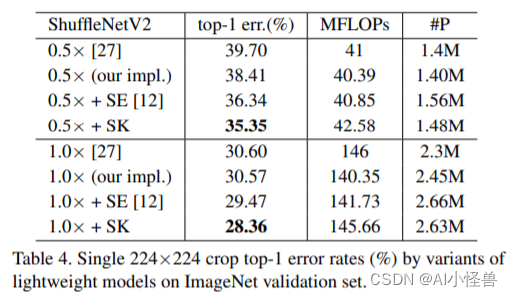

YOLOv9改进策略:注意力机制 | SKAttention注意力效果优于SENet

💡💡💡本文改进内容:SKAttention输入自适应地调整其感受野大小的能力 yolov9-c-SKAttention summary: 987 layers, 73109830 parameters, 73109798 gradients, 256.5 GFLOPs 改进结构图如下: YOLOv9魔术师专栏 ☁️☁️☁️☁️☁️☁️☁️☁️☁️☁️☁️☁️☁️

SeNet学习笔记及仿真

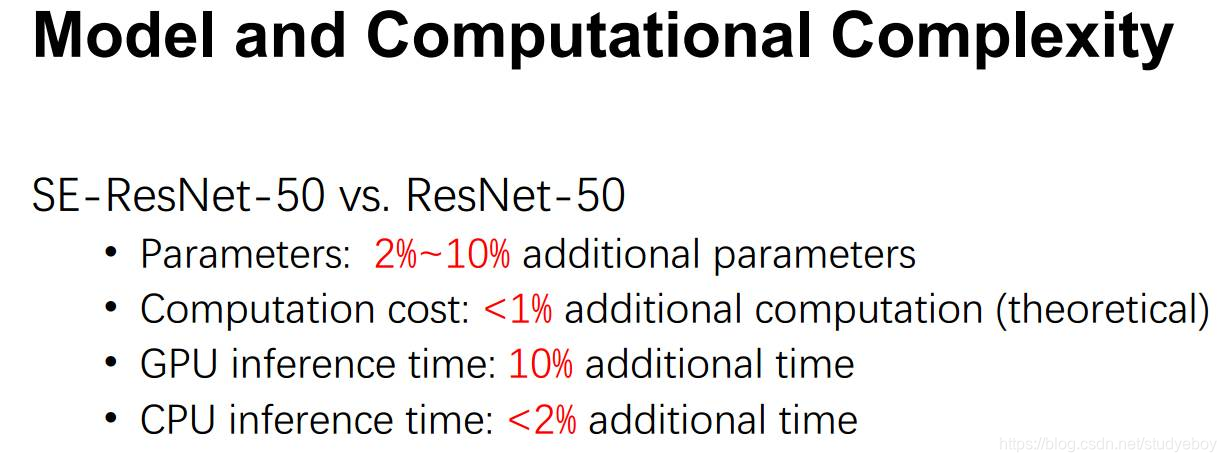

SeNet学习笔记及仿真 前言 SENet[1]是ImageNet 2017年的冠军模型,自SeNet提出后,ImageNet挑战赛就停止举办了。SENet同之前的ResNet一样,引入了一些技巧,可以在很大程度上降低模型的参数,并且提升模型的运算速度。 SENet全称Squeeze-and-Excitation Networks,中文名可以翻译为挤压和激励网络。SENet在ImageNet

SENet(2017)

卷积核作为卷积神经网络的核心,通常被看作是在局部感受野上,将空间上(spatial)的信息和特征维度上(channel-wise)的信息进行聚合的信息聚合体。卷积神经网络由一系列卷积层、非线性层和下采样层构成,这样它们能够从全局感受野上去捕获图像的特征来进行图像的描述。 去学到一个性能非常强劲的网络是相当困难的,从空间维度层面来提升网络的性能,如Inception结构中嵌入了多尺度信息,聚合多种

attention机制SENET、CBAM模块原理总结

参考博客:https://blog.csdn.net/weixin_33602281/article/details/85223216 def cbam_module(inputs,reduction_ratio=0.5,name=""):with tf.variable_scope("cbam_"+name, reuse=tf.AUTO_REUSE):#假如输入是[batsize,h,w,ch

Keras实现Senet block模块

一、keras实现的Senet block模块代码 import kerasclass SeBlock(keras.layers.Layer): def __init__(self, reduction=4,**kwargs):super(SeBlock,self).__init__(**kwargs)self.reduction = reductiondef build(self,inp

『青年AI自强计划』第6章视觉分类任务LeNet5,AlexNet,ZFNet,VGG,GoogleNet,ResNet,ResNeXt,SENet,MobileNet!

视觉分类任务 文章目录 一、分类任务简介1.1、分类发展简史 二、卷积知识回顾2.1、卷积运算2.2、池化运算2.3、padding运算2.4、三维卷积(池化)2.5、LeNet5 :一切的原点 三、AlexNet&ZFNet3.1、AlexNet(2012):深度CNN与BD的首次触电3.2、ZFNet(2013):过渡,对AlexNet小调整 四、VGG(2014):“标准模块+堆叠”

pytorch实现的通道注意力机制SENet的代码

通道注意力机制SENet Diagram of a Squeeze-and-Excitation building block 实现代码如下 import torchimport torch.nn as nnclass SELayer(nn.Module):def __init__(self, channel, reduction=16):super(SELayer, sel

【卷积神经网络发展历程】从LeNet、AlexNet到ResNet、SENet

经典的LeNet诞生于1998年。然而之后CNN的锋芒开始被SVM等手工设计的特征盖过。随着ReLU和dropout的提出,以及GPU和大数据带来的历史机遇,CNN在2012年迎来了历史突破–AlexNet,从此CNN呈现爆炸式发展。 从此,Deep Learning一发不可收拾,ILSVRC每年都不断被Deep Learning刷榜,如图1所示,随着模型变得越来越深,Top-5

SENet详解-最后一届ImageNet冠军模型

声明:文章仅作知识整理、分享,如有侵权请联系作者删除博文,谢谢! 经典分类网络(传送门):目录索引、LeNet、AlexNet、VGG、ResNet、Inception、DenseNet、SeNet。 SENet最后一届 ImageNet 2017 竞赛 Image Classification 任务的冠军,也是目前细粒度分类任务的必选基础网络。CNN是通过用局部感受野,基于逐通道基础上,去融

YOLO算法改进5【中阶改进篇】:添加SENet注意力机制

SE-Net 是 ImageNet 2017(ImageNet 收官赛)的冠军模型,是由WMW团队发布。具有复杂度低,参数少和计算量小的优点。且SENet 思路很简单,很容易扩展到已有网络结构如 Inception 和 ResNet 中。 我们可以看到,已经有很多工作在空间维度上来提升网络的性能。那么很自然想到,网络是否可以从其他层面来考虑去提升性能,比如考虑特征通道之间的关系?作者基于这一点

【CV中的Attention机制】基础篇-视觉注意力机制和SENet

注意力机制 注意力机制(Attention Mechanism)是机器学习中的一种数据处理方法,广泛应用在自然语言处理、图像识别及语音识别等各种不同类型的机器学习任务中。注意力机制本质上与人类对外界事物的观察机制相似。通常来说,人们在观察外界事物的时候,首先会比较关注比较倾向于观察事物某些重要的局部信息,然后再把不同区域的信息组合起来,从而形成一个对被观察事物的整体印象。Attention机制最

视觉注意力机制 | 视觉注意力机制用于分类:SENet、CBAM、SKNet

点击上方“AI算法修炼营”,选择加星标或“置顶” 标题以下,全是干货 前面的话 上次文章中,我们主要关注了视觉应用中的Self-attention机制及其应用——Non-local网络模块,从最开始的了解什么是视觉注意力机制到对自注意力机制的细节把握,再到Non-local模块的学习。这次的文章我主要来关注视觉注意力机制在分类网络中的应用——SENet、SKNet、CBAM。 我们通常将软注意力

SENet(Squeeze-and-Excitation Networks)算法笔记

-SENet(Squeeze-and-Excitation Networks)算法笔记 –通过学习的方式来自动获取到每个特征通道的重要程度,然后依照这个重要程度去提升有用的特征并抑制对当前任务用处不大的特征 Momenta详解ImageNet 2017夺冠架构SENet 转自机器之心专栏 作者:胡杰 本届 CVPR 2017大会上出现了很多值得关注的精彩论文,国内自动驾驶创业公司 Momen

经典卷积神经网络总结:Inception v1\v2\v3\v4、ResNet、ResNext、DenseNet、SENet等

本文为总结今年来的卷积神经网络,主要按照时间线和方法类似程度的顺序总结。 开篇先前说下概要,然后展开详细介绍,主要是在densenet、resnext、senet这三个网络上介绍,前面的一系列网络大概讲一下思想。 1、时间轴 时间团队论文2014.09googleInception v12015.02googleInception v22015.12googleInception v32

![[总结] SEnet](https://img-blog.csdnimg.cn/ebc83cb7f73041d894f01a6bfdee1181.png?x-oss-process=image/watermark,type_d3F5LXplbmhlaQ,shadow_50,text_Q1NETiBA54aK54aK55qE5bCP5b-D5b-D,size_20,color_FFFFFF,t_70,g_se,x_16)