本文主要是介绍python爬取百度百科词条内容,希望对大家解决编程问题提供一定的参考价值,需要的开发者们随着小编来一起学习吧!

LZ最近在学习python的相关知识,尤其是爬虫这一块,所以就拿百度百科来练练手 ,正好网上也有一些资源供借鉴,体会了一把python爬虫的精髓。

,正好网上也有一些资源供借鉴,体会了一把python爬虫的精髓。

一、准备工作

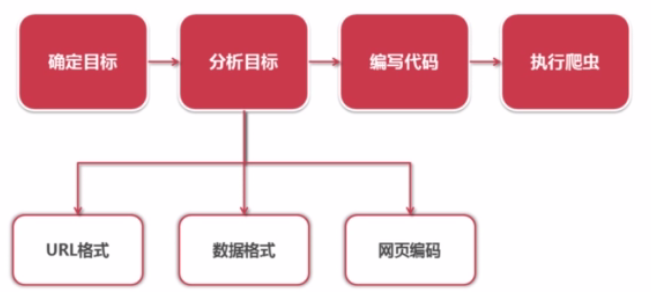

LZ用的是python2.7版本,相对于python 3.0版本,2.7版本目前还是主流。用到了BeautifulSoup、re和urlparse等第三方库。首先将爬虫过程分为五个部分,分别为spider_main.py爬虫调度程序、url_manager.py爬虫URL管理器,维护两个set,一个是为将要爬取信息的url,另一个是已经爬取过的url;html_downloader.py(html下载器)、html_parser.py(html内容解析器)、html_outputer.py结果收集和展示工具。通过以上5个部分的爬取工具,可以实现对某个网页的爬取。

二、爬虫调度程序

spider_main.py

import url_manager

import html_downloader

import html_outputer

import html_parser class SpiderMain(object): # 初始各个对象, 其中UrlManager、HtmlDownloader、HtmlParser、HtmlOutputer四个对象需要之后创建 def __init__(self): #这个是此类的初始化方法self.urls = url_manager.UrlManager() # URL管理器 self.downloader = html_downloader.HtmlDownloader() # 下载器 self.parser = html_parser.HtmlParser() # 解析器 self.outputer = html_outputer.HtmlOutputer() # 输出器 def craw(self, root_url): count = 1 #用来记录爬取过的url# 将root_url添加到url管理器 self.urls.add_new_url(root_url) # 只要添加的url里有新的url while self.urls.has_new_url(): try: new_url = self.urls.get_new_url() print 'craw %d : %s' % (count, new_url) # 启动下载器,将获取到的url下载下来 html_cont = self.downloader.download(new_url) # 调用解析器解析下载的这个页面 new_urls, new_data = self.parser.parse(new_url, html_cont) # 将解析出的url添加到url管理器, 将数据添加到输出器里 self.urls.add_new_urls(new_urls) self.outputer.collect_data(new_data) if count == 10: #爬取的网页个数打到10个,那么就退出 break count = count + 1 except: #如果有异常,那么就抛出异常,并输出crew failedprint 'craw failed' self.outputer.output_html() #用来在网页中显示结果if __name__ == "__main__": root_url = "http://baike.baidu.com/view/21087" # 这个URL根据实际情况的url进行修改 obj_spider = SpiderMain() obj_spider.craw(root_url) # 启动爬虫 三、url管理器

class UrlManager(object): def __init__(self): self.new_urls = set() #首先生成了两个set集合,用于存放新旧的url,其中用set是为了保证存放在其中的url没有出现重复self.old_urls = set() def add_new_url(self, url): #去除新的url,存放到集合中去,但是需要审核是否该url已经在集合中了if url is None: return if url not in self.new_urls and url not in self.old_urls: self.new_urls.add(url) def add_new_urls(self, urls): #向新的urls集合中添加urlif urls is None or len(urls) == 0: return for url in urls: self.add_new_url(url) def has_new_url(self): #判断url集合中是否存在该urlreturn len(self.new_urls) != 0 def get_new_url(self): #得到新的url,从新的url集合中取,在旧的url集合中加入已经爬取过的urlnew_url = self.new_urls.pop() self.old_urls.add(new_url) return new_url

import urllib2 class HtmlDownloader(object): #将某个url对应的网页的html内容下载下来def download(self, url): if url is None: #判断是否url为空return None response = urllib2.urlopen(url) if response.getcode() != 200: #查看返回的urlcode是否为200,如果为200,则表明其反馈的结果是正常的return None return response.read() #返回网页的html代码五、 html_parser.py (HTML解析器)

这个是关键,用于将所需要爬取的内容进行获取,也就是采用正则表达式将网页中所需内容获取出来

import urlparse

import re

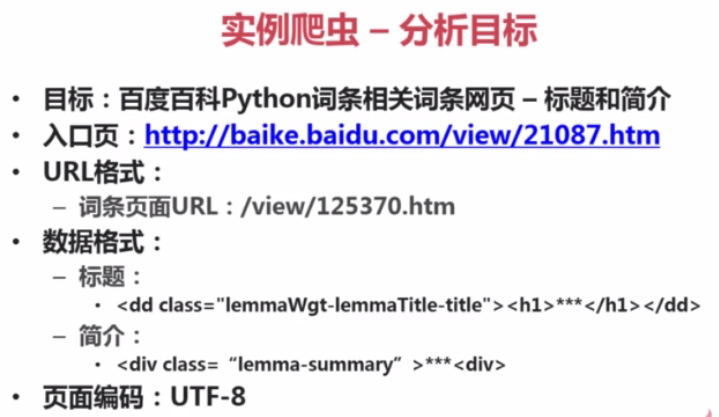

from bs4 import BeautifulSoup class HtmlParser(object): def parse(self, page_url, html_cont): if page_url is None or html_cont is None: return soup = BeautifulSoup(html_cont, 'html.parser') #此处不要加from_encoding='utf-8',因为这会导致报错,此处的错误是You provided unicode markup but also provided a value for from_encoding.You from_encoding will be ignore. pat1 = soup.find('div',class_='lemma-summary') #限定在百度百科头部的标题部分获取内容 new_urls = self._get_new_urls(page_url, pat1) #获取新的url new_data = self._get_new_data(page_url, soup) #获取新的内容return new_urls, new_data def _get_new_urls(self, page_url, soup): new_urls = set() links = soup.find_all('a', href=re.compile(r"/item/.*)) #正则表达式for link in links: new_url = link['href'] #获取href,即url的内容new_full_url = urlparse.urljoin(page_url, new_url) #将新获取的url和开头的url合并new_urls.add(new_full_url) return new_urls def _get_new_data(self, page_url, soup): res_data = {} # url res_data['url'] = page_url # <dd class="lemmaWgt-lemmaTitle-title"><h1>Python</h1> title_node = soup.find('dd', class_="lemmaWgt-lemmaTitle-title").find("h1") res_data['title'] = title_node.get_text() summary_node = soup.find('div', class_="lemma-summary") res_data['summary'] = summary_node.get_text() return res_data 六、html_outputer.py html输出器

class HtmlOutputer(object): def __init__(self): self.datas = [] def collect_data(self, data): if data is None: return self.datas.append(data) def output_html(self): #用于将所爬取的内容在网页中表示fout = open('output.html', 'w') fout.write("<html>") fout.write("<body>") fout.write("<table>") for data in self.datas: fout.write("<tr>") fout.write("<td>%s</td>" % data['url']) fout.write("<td>%s</td>" % data['title'].encode('utf-8')) fout.write("<td>%s</td>" % data['summary'].encode('utf-8')) fout.write("</tr>") fout.write("</table>") fout.write("</body>") fout.write("</html>") fout.close() 通过以上的操作,即可将所爬取的内容进行获取。

通过以上的过程,我们将上述爬虫爬下来即可。

这篇关于python爬取百度百科词条内容的文章就介绍到这儿,希望我们推荐的文章对编程师们有所帮助!