本文主要是介绍数据仓库系列15:数据集成的常见挑战有哪些,如何应对?,希望对大家解决编程问题提供一定的参考价值,需要的开发者们随着小编来一起学习吧!

在大数据时代,数据集成已成为数据仓库建设中不可或缺的一部分。无论是来自多个数据库、外部数据源,还是实时数据流的整合,数据集成都面临着诸多挑战。那么,这些挑战具体是什么,我们又该如何应对呢?本文将通过具体的案例与逻辑深入探讨这个问题。

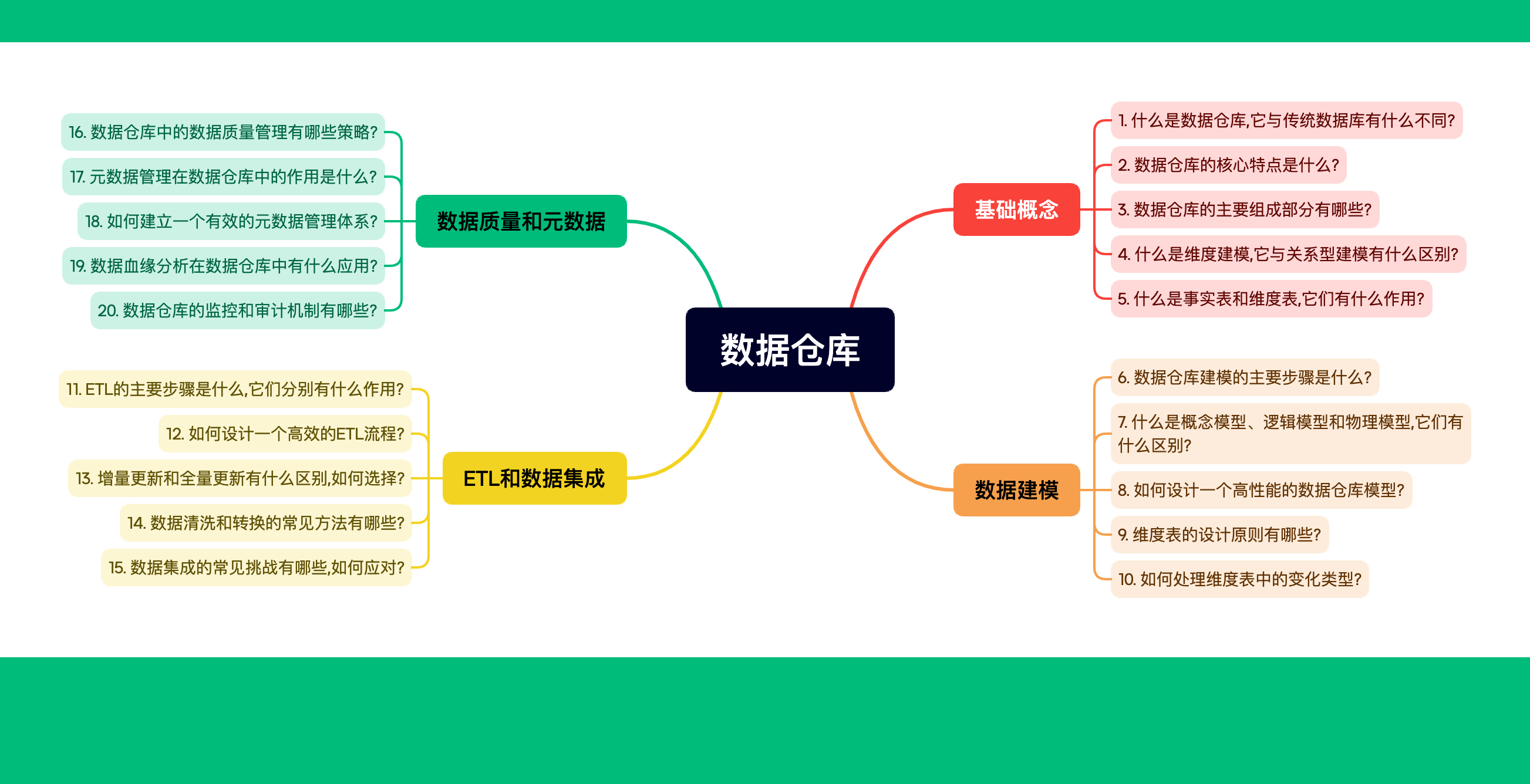

目录

- 1. 什么是数据集成?

- 2. 数据集成的常见挑战

- 2.1 数据源的多样性

- 2.2 数据质量问题

- 2.3 数据延迟

- 2.4 数据安全与隐私

- 2.5 系统性能

- 3. 案例分析:如何应对数据集成中的挑战

- 3.1 案例背景

- 3.2 数据源的多样性

- 3.3 数据质量问题

- 3.4 数据延迟

- 3.5 数据安全与隐私

- 3.6 系统性能

- 4. 结论

1. 什么是数据集成?

数据集成是指将来自不同源的数据统一管理,使之在数据仓库中能够无缝协同工作。它包括从不同的数据源收集数据、清洗数据、转换数据以及加载到数据仓库中的过程(ETL流程:Extract, Transform, Load)。

2. 数据集成的常见挑战

2.1 数据源的多样性

挑战:不同数据源的数据结构、格式和质量参差不齐。例如,某企业可能会从CRM系统、ERP系统、第三方API获取数据,这些数据可能以结构化(如SQL数据库)、半结构化(如JSON文件)或非结构化(如文本)形式存在。

应对策略:

- 标准化数据格式:在集成之前,定义一个标准的内部数据格式,所有数据在进入数据仓库之前都需转化为该格式。

- 使用中间层:设计一个数据中间层,用来处理不同来源的数据转换,确保它们能够被标准化处理。

- 数据虚拟化:借助数据虚拟化技术,创建一个统一的数据访问层,使不同格式和结构的数据可以被统一查询。

-- 示例:使用SQL标准化不同数据源的数据格式

SELECT customer_id, CAST(order_date AS DATE) AS order_date, CAST(order_total AS DECIMAL(10, 2)) AS order_total

FROM (SELECT id AS customer_id, date_created AS order_date, total_amount AS order_total FROM crm_ordersUNION ALLSELECT cust_id AS customer_id, order_date AS order_date, total_price AS order_total FROM erp_orders) AS unified_orders;

2.2 数据质量问题

挑战:数据集成过程中,可能会遇到数据不一致、重复、缺失、错误等问题,这会严重影响数据的准确性和可靠性。

应对策略:

- 数据清洗:在数据进入仓库前进行清洗和校验,删除重复数据、补全缺失值、修正错误数据。

- 数据校验规则:定义严格的校验规则,确保数据质量。例如,检查电子邮件格式、电话号码长度等。

- 使用数据质量工具:借助第三方数据质量工具进行自动化的数据清洗和质量检查。

# 示例:使用Python进行数据清洗

import pandas as pd# 读取数据

data = pd.read_csv('customer_data.csv')# 去除重复值

data.drop_duplicates(inplace=True)# 填充缺失值

data['email'].fillna('no_email@example.com', inplace=True)# 校验格式

data = data[data['email'].str.contains(r'^[\w\.-]+@[\w\.-]+$', na=False)]

data = data[data['phone'].str.len() == 10]# 保存清洗后的数据

data.to_csv('cleaned_customer_data.csv', index=False)

2.3 数据延迟

挑战:实时性需求越来越高,但数据从多个源抽取、转换、加载的过程可能会导致延迟,无法满足实时分析的需要。

应对策略:

- 增量加载:只加载变化或新增的数据,而不是每次加载全部数据,减少处理时间。

- 流式处理:采用流式数据处理框架,如Apache Kafka和Apache Flink,来处理实时数据流。

- 数据分片:通过分片(sharding)技术,将数据分散到多个节点上并行处理,以提高数据处理速度。

// 示例:使用Apache Kafka进行实时数据处理

import org.apache.kafka.clients.consumer.ConsumerRecord;

import org.apache.kafka.clients.consumer.KafkaConsumer;

import org.apache.kafka.clients.consumer.ConsumerConfig;

import java.util.Collections;

import java.util.Properties;public class RealTimeDataProcessor {public static void main(String[] args) {Properties props = new Properties();props.put(ConsumerConfig.BOOTSTRAP_SERVERS_CONFIG, "localhost:9092");props.put(ConsumerConfig.GROUP_ID_CONFIG, "real-time-group");props.put(ConsumerConfig.KEY_DESERIALIZER_CLASS_CONFIG, "org.apache.kafka.common.serialization.StringDeserializer");props.put(ConsumerConfig.VALUE_DESERIALIZER_CLASS_CONFIG, "org.apache.kafka.common.serialization.StringDeserializer");KafkaConsumer<String, String> consumer = new KafkaConsumer<>(props);consumer.subscribe(Collections.singletonList("real-time-topic"));while (true) {for (ConsumerRecord<String, String> record : consumer.poll(1000)) {System.out.printf("Offset = %d, Key = %s, Value = %s%n", record.offset(), record.key(), record.value());// 处理数据逻辑}}}

}

2.4 数据安全与隐私

挑战:在集成数据时,特别是涉及到敏感信息的数据,如用户个人信息、财务数据等,如何保护数据的安全和隐私是一个严峻的问题。

应对策略:

- 数据加密:对传输和存储中的数据进行加密,防止未授权的访问。

- 访问控制:设置严格的访问控制,确保只有授权用户可以访问敏感数据。

- 数据脱敏:在展示或处理数据时,使用数据脱敏技术,隐藏敏感信息。

-- 示例:SQL中的数据脱敏

SELECT customer_id, LEFT(email, 3) + '****' + RIGHT(email, 3) AS email, CONCAT('****', RIGHT(phone, 4)) AS phone

FROM customers;

2.5 系统性能

挑战:随着数据量的增加,数据集成过程可能会导致系统性能下降,影响整体业务系统的响应速度。

应对策略:

- 数据分区:将数据划分为多个分区,按需加载,提高处理速度。

- 索引优化:在关键字段上创建索引,优化查询性能。

- 采用并行处理:利用分布式计算框架,如Apache Spark,进行并行处理,提高数据处理速度。

-- 示例:SQL中的数据分区

CREATE TABLE orders_partitioned (order_id INT,customer_id INT,order_date DATE,order_total DECIMAL(10, 2)

)

PARTITION BY RANGE (order_date) (PARTITION p2024 VALUES LESS THAN ('2024-01-01'),PARTITION p2025 VALUES LESS THAN ('2025-01-01')

);

3. 案例分析:如何应对数据集成中的挑战

为了更好地理解数据集成中的这些挑战及其应对策略,我们将通过一个实际案例来具体说明。这一案例涉及一家全球零售公司的数据集成项目,该公司希望整合来自不同市场、多个系统的销售数据,以便更好地进行全球业务分析。

3.1 案例背景

该公司在多个国家运营,每个国家都有自己独立的销售系统。这些系统之间存在显著的差异:

- 数据格式:某些系统使用关系型数据库,如MySQL,而其他系统则使用NoSQL数据库,如MongoDB。

- 数据结构:销售数据的字段在不同系统中不统一,如客户ID在某些系统中是数字,而在其他系统中是字符串。

- 数据质量:不同市场的数据质量标准不一致,有些系统中存在大量缺失值和重复数据。

- 数据安全:由于涉及到敏感的客户信息,数据安全和隐私保护是首要考虑。

3.2 数据源的多样性

挑战:

不同市场的系统使用了不同的数据库类型和数据格式,这使得数据集成变得复杂。

解决方案

的数据格式和结构差异使得整合这些数据变得复杂。例如,MySQL系统中的销售数据可能存储在多张表中,每张表都有自己的外键约束,而MongoDB中的销售数据可能是嵌套的文档结构。

应对策略:

-

统一数据模型:设计一个统一的数据模型,用于表示销售数据的标准格式。所有数据在加载到数据仓库之前都需转换为此统一格式。例如,使用一个公共的“销售”表结构,包括统一的字段名称和数据类型。

-

数据转换和映射:使用ETL工具,如Apache Nifi、Talend或Informatica,执行数据的抽取、转换和加载过程。为不同的数据源编写特定的转换脚本,将它们映射到统一的数据模型中。

-

使用数据湖架构:数据湖允许将不同格式的数据存储在一个地方,同时保持原始数据的完整性。然后,通过元数据层提供一致的访问接口,使数据分析工具能够跨越不同的数据格式。

-- 示例:通过SQL视图统一数据结构

CREATE VIEW unified_sales AS

SELECT id AS sale_id,DATE_FORMAT(sale_date, '%Y-%m-%d') AS sale_date,CAST(amount AS DECIMAL(10, 2)) AS sale_amount,customer_id AS customer_identifier

FROM mysql_sales

UNION ALL

SELECT _id AS sale_id,TO_DATE(saleDate, 'yyyy-MM-dd') AS sale_date,CAST(totalAmount AS DECIMAL(10, 2)) AS sale_amount,custID AS customer_identifier

FROM mongodb_sales;

3.3 数据质量问题

挑战:

数据的完整性和准确性是数据分析的基础。然而,来自不同市场的销售数据在格式、内容上存在显著差异。一些系统中可能缺少客户ID或者订单金额为负值。

应对策略:

-

数据清洗和预处理:在将数据加载到数据仓库之前,进行严格的数据清洗。使用数据质量工具和脚本清除重复数据、填补缺失值,并确保数据符合业务规则。

-

数据质量监控:实施自动化的数据质量监控,及时发现和报告数据质量问题。使用日志和报警系统跟踪数据质量的变化。

-

数据验证:引入数据验证规则,例如确保订单金额为正值,日期格式正确,客户ID存在于客户表中。这可以通过ETL过程中的规则和条件来实现。

# 示例:Python数据清洗脚本

import pandas as pd# 加载数据

sales_data = pd.read_csv('sales_data.csv')# 清除重复记录

sales_data.drop_duplicates(inplace=True)# 填补缺失值

sales_data['customer_identifier'].fillna('UNKNOWN', inplace=True)# 检查订单金额是否合法

sales_data = sales_data[sales_data['sale_amount'] > 0]# 保存清洗后的数据

sales_data.to_csv('cleaned_sales_data.csv', index=False)

3.4 数据延迟

挑战:

面对实时性需求,传统的批量数据处理可能导致数据延迟,使公司无法及时响应市场变化。例如,日终处理方式可能无法满足实时库存管理和销售分析的需求。

应对策略:

-

实时数据集成:采用实时数据处理框架,如Apache Kafka和Apache Storm,将销售数据实时流式传输到数据仓库中。

-

增量数据加载:实现增量ETL流程,只加载新增加或更新的数据,而不是每次重新加载所有数据。这样可以显著减少数据处理时间。

-

缓存机制:利用缓存来存储最近的数据请求结果,减少对底层数据仓库的访问频率,提高系统响应速度。

// 示例:使用Kafka处理实时数据流

import org.apache.kafka.clients.producer.KafkaProducer;

import org.apache.kafka.clients.producer.ProducerRecord;

import java.util.Properties;public class RealTimeSalesDataProducer {public static void main(String[] args) {Properties props = new Properties();props.put("bootstrap.servers", "localhost:9092");props.put("key.serializer", "org.apache.kafka.common.serialization.StringSerializer");props.put("value.serializer", "org.apache.kafka.common.serialization.StringSerializer");KafkaProducer<String, String> producer = new KafkaProducer<>(props);String salesRecord = "{\"sale_id\": 12345, \"sale_date\": \"2024-08-30\", \"sale_amount\": 99.99}";producer.send(new ProducerRecord<>("sales-topic", "salesKey", salesRecord));producer.close();}

}

3.5 数据安全与隐私

挑战:

跨国企业需要遵守不同国家和地区的数据保护法规,如GDPR。这意味着必须确保数据的安全存储和传输,防止数据泄露和未授权访问。

应对策略:

-

数据加密:在数据传输和存储中应用加密技术,确保敏感数据(如客户信息)受到保护。采用TLS/SSL协议保护数据传输,加密算法如AES用于存储数据。

-

数据访问控制:实施基于角色的访问控制(RBAC),限制不同角色对敏感数据的访问权限。确保只有授权的用户能够查看和操作敏感信息。

-

数据脱敏:在分析过程中使用数据脱敏技术,隐藏或模糊化敏感信息,确保数据在展示和处理时不会泄露个人隐私。

-- 示例:基于角色的访问控制

GRANT SELECT ON sales TO 'analyst_role';

REVOKE SELECT, INSERT, UPDATE, DELETE ON customer_sensitive_data FROM 'analyst_role';

3.6 系统性能

挑战:

随着数据量的增加,集成系统可能会出现性能瓶颈,导致响应速度变慢,影响用户体验和业务决策效率。例如,复杂的跨表查询可能导致数据库负载过高。

应对策略:

-

数据库优化:定期优化数据库索引,确保查询能够高效执行。对经常查询的大表进行分区和分片,减少查询时间。

-

分布式计算:利用Hadoop、Spark等分布式计算框架,分散数据处理任务,提升数据处理能力和效率。

-

水平扩展:通过增加更多的计算节点和存储节点来提升系统的处理能力,确保系统能够应对数据量的增长。

-- 示例:创建索引以提高查询性能

CREATE INDEX idx_sales_date ON sales (sale_date);

4. 结论

数据集成在现代数据仓库和大数据处理中的重要性不言而喻。通过理解和应对数据集成中的常见挑战,如数据源的多样性、数据质量问题、数据延迟、数据安全与隐私,以及系统性能,我们可以为企业提供高效、安全、实时的数据信息支持。这不仅有助于企业做出明智的商业决策,还能提升整体业务竞争力。

未来,随着技术的不断进步和数据量的持续增长,数据集成的挑战也会不断变化。我们需要持续学习和优化数据集成策略,以适应新的需求和技术环境。

这篇博客以详细案例的方式,深入探讨了数据集成中的实际挑战及其应对策略,供大数据开发者参考和学习。如果有更多具体问题或需要进一步探讨的主题,请随时联系!

这篇关于数据仓库系列15:数据集成的常见挑战有哪些,如何应对?的文章就介绍到这儿,希望我们推荐的文章对编程师们有所帮助!