本文主要是介绍神经网络实战——基于TensorFlow的MNIST手写数据集实现,希望对大家解决编程问题提供一定的参考价值,需要的开发者们随着小编来一起学习吧!

TensorFlow实战——基于神经网络的MNIST手写数据集实现

- 一、代码结果

- 二、代码展示

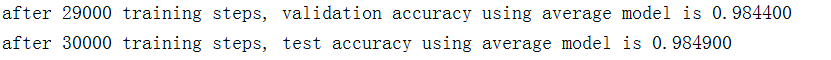

说明:前几篇博客已经介绍了TensorFlow的基本知识以及神经网络的简单实现,该篇博客通过一个具体例子来具体回顾前面所讲的内容。通过该神经网络,可以达到98.4%的正确率。

一、代码结果

二、代码展示

"""

this script shows how to realize MNIST_dataset by neural network.

As a result, its accuracy is about 98.4%

"""import tensorflow as tf

from tensorflow.examples.tutorials.mnist import input_data# 关于MNIST数据集的一些常量

# 输入层节点数,等于图片的像素点的个数,28*28

INPUT_LAYER = 784

# 输出层节点数,等于MNIST数据集中类别的数目

OUTPUT_LAYER = 10# 配置神经网络参数

# 隐藏层节点数

HIDDEN_LAYER = 500

# 一个训练batch中训练数据的个数。数字越小,训练越接近随机梯度下降;数据越大,训练越接近梯度下降

BATCH_SIZE = 100

# 基础学习率

LEARNING_RATE_BASE = 0.8

# 学习率的衰减率

LEARNING_RATE_DECAY = 0.99

# 描述模型复杂度的正则化项在损失函数中的系数

REGULARIZATION_RATE = 0.0001

# 训练轮数

TRAINING_STEPS = 30000

# 滑动平均衰减率

MOVING_AVERAGE_DECAY = 0.99def inference(input_tensor, avg_class, weights1, biases1, weights2, biases2):"""一个辅助函数,给定神经网络的输入和所有参数,计算神经网络的前向传播结果。在这里定义了一个使用Relu激活函数的三层全连接神经网络。通过加入隐藏层实现了多层网络结构,通过Relu激活函数去线性化。在这个函数中也支持传入用于计算参数平均值的类,这样方便在测试时使用滑动平均模型"""# 当没有提供滑动平均类时,直接使用参数当前的取值if avg_class is None:layer1 = tf.nn.relu(tf.matmul(input_tensor, weights1) + biases1)print("[DEBUG] layer1.shape: {}".format(layer1))print("[DEBUG] biases2.shape: {}".format(biases2))print("[DEBUG] weights2.shape: {}".format(weights2))# 计算输出层的前向传播结果。因为在计算损失函数时会一起计算softmax函数,所以这里不需要加入激活函数。# 而且不加入softmax不会影响预测结果。return tf.matmul(layer1, weights2) + biases2else:# 首先使用avg_class.average计算变量的滑动平均值,然后计算神经网络的前向传播结果layer1 = tf.nn.relu(tf.matmul(input_tensor, avg_class.average(weights1)) + avg_class.average(biases1))return tf.matmul(layer1, avg_class.average(weights2)) + avg_class.average(biases2)def train(mnist):x = tf.placeholder(tf.float32, shape=(None, INPUT_LAYER), name="x_input")y_real = tf.placeholder(tf.float32, shape=(None, OUTPUT_LAYER), name="y_real")# 隐藏层参数weight1 = tf.Variable(tf.truncated_normal([INPUT_LAYER, HIDDEN_LAYER], stddev=0.1))biases1 = tf.Variable(tf.constant(value=0.1, shape=[HIDDEN_LAYER]))# 输出层参数weight2 = tf.Variable(tf.truncated_normal([HIDDEN_LAYER, OUTPUT_LAYER], stddev=0.1))biases2 = tf.Variable(tf.constant(value=0.1, shape=[OUTPUT_LAYER]))# 计算当前参数下前向传播的结果,这里用于计算滑动平均的类为None,所以函数不会使用参数的滑动平均值y_pred = inference(x, None, weight1, biases1, weight2, biases2)# 定义训练的轮数,这个变量不需要计算滑动平均值,所以指定为不可训练的变量。使用TensorFlow训练神经网络时,一般将# 代表训练轮数的变量指定为不可训练的参数(trainable=false)global_step = tf.Variable(0, trainable=False)# 给定滑动平均衰减率和训练的轮数,初始化滑动平均类variables_averages = tf.train.ExponentialMovingAverage(MOVING_AVERAGE_DECAY, global_step)# 在所有代表神经网络的参数的变量上使用滑动平均。tf.trainable_variables()返回图上集合GraphKeys.TRAINABLE_VARIABLES# 中的元素,这个集合就是所有没有指定trainable=False的参数variables_averages_op = variables_averages.apply(tf.trainable_variables())# 计算使用滑动平均之后的前向传播结果y_pred_average = inference(x, variables_averages, weight1, biases1, weight2, biases2)# print("[DEBUG] y_pred.shape: {}".format(y_pred))# print("[DEBUG] tf.argmax(y_real, axis=1).shape: {}".format(tf.argmax(y_real, 1)))# 计算交叉熵刻画预测值和真实值之间差距的损失函数。cross_entropy = tf.nn.sparse_softmax_cross_entropy_with_logits(logits=y_pred, labels=tf.argmax(y_real, axis=1))# 计算当前batch中交叉熵均值cross_entropy_mean = tf.reduce_mean(cross_entropy)# 计算l2正则化损失函数regularizer = tf.contrib.layers.l2_regularizer(REGULARIZATION_RATE)regularization = regularizer(weight1) + regularizer(weight2)# 总损失等于交叉熵损失加正则化损失total_loss = cross_entropy_mean + regularization# 设置指数衰减学习率learning_rate = tf.train.exponential_decay(LEARNING_RATE_BASE, global_step, mnist.train.num_examples / BATCH_SIZE,LEARNING_RATE_DECAY)# 使用梯度下降优化算法优化损失函数train_step = tf.train.GradientDescentOptimizer(learning_rate).minimize(total_loss, global_step=global_step)# 在训练神经网络模型时,每过一遍数据既需要通过反向传播来更新神经网络参数,又要更新每一个参数的滑动平均值。# 为了一次完成多个操作,TensorFlow提供了tf.control_dependencies和tf.group两种机制,下面两种机制等价# train_op = tf.group(train_step, variables_averages_op)with tf.control_dependencies([train_step, variables_averages_op]):train_op = tf.no_op(name="train")# 检验使用了滑动平均模型的神经网络前向传播结果是否正确correct_prediction = tf.equal(tf.argmax(y_pred_average, 1), tf.argmax(y_real, 1))accuracy = tf.reduce_mean(tf.cast(correct_prediction, tf.float32))# 初始化会话并开始训练过程with tf.Session() as sess:tf.global_variables_initializer().run()# 准备验证数据validate_feed = {x: mnist.validation.images, y_real: mnist.validation.labels}# 准备测试数据test_feed = {x: mnist.test.images, y_real: mnist.test.labels}# 训练神经网络for i in range(TRAINING_STEPS):# 每1000轮输出一下在验证集上的测试结果if i % 1000 == 0:validate_acc = sess.run(accuracy, feed_dict=validate_feed)print("after %d training steps, validation accuracy using average model is %f" % (i, validate_acc))# 产生这一轮使用的一个batch的训练数据,并允许训练过程xs, ys = mnist.train.next_batch(BATCH_SIZE)sess.run(train_op, feed_dict={x: xs, y_real: ys})# 在训练结束后,在测试数据上检测神经网络模型的最终正确率test_acc = sess.run(accuracy, feed_dict=test_feed)print("after %d training steps, test accuracy using average model is %f" % (TRAINING_STEPS, test_acc))def main(argv=None):# 声明MNIST数据集的类,这个类在初始化时会自动下载数据mnist = input_data.read_data_sets("/data", one_hot=True)train(mnist)if __name__ == '__main__':tf.app.run()这篇关于神经网络实战——基于TensorFlow的MNIST手写数据集实现的文章就介绍到这儿,希望我们推荐的文章对编程师们有所帮助!