本文主要是介绍数据可视化分析工具DataEase,希望对大家解决编程问题提供一定的参考价值,需要的开发者们随着小编来一起学习吧!

本文软件由网友

雨林推荐,老苏稍微研究了一下DataEase的安装,具体的使用教程,请参考官方的在线文档和教学视频

什么是 DataEase ?

DataEase是开源的数据可视化分析工具,帮助用户快速分析数据并洞察业务趋势,从而实现业务的改进与优化。DataEase支持丰富的数据源连接,能够通过拖拉拽方式快速制作图表,并可以方便的与他人分享。

DataEase 的优势:

- 开源开放:零门槛,线上快速获取和安装,按月迭代;

- 简单易用:极易上手,通过鼠标点击和拖拽即可完成分析;

- 全场景支持:多平台安装和多样化嵌入支持;

- 安全分享:支持多种数据分享方式,确保数据安全。

安装

在群晖上以 Docker 方式安装。

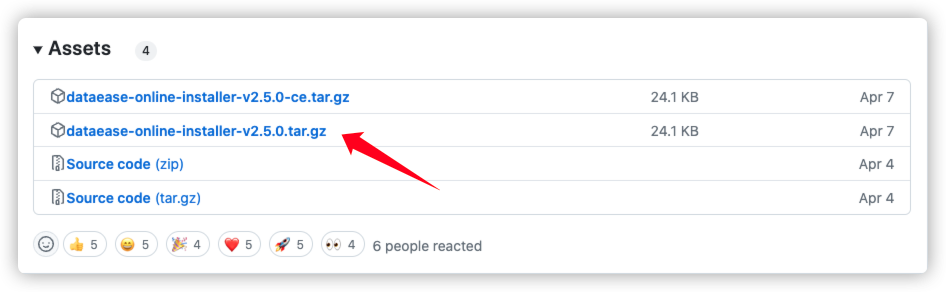

采用 docker-compose 安装,安装所需的文件均来自:hhttps://github.com/dataease/dataease/releases

老苏折腾时,版本为

v2.5.0

老苏根据需要,对相应的文件做了微调,所需的文件可以在 https://github.com/wbsu2003/synology/tree/main/DataEase 找到,直接下载 dataease_standalone.zip 即可,下面简单介绍一下涉及到的几个文件

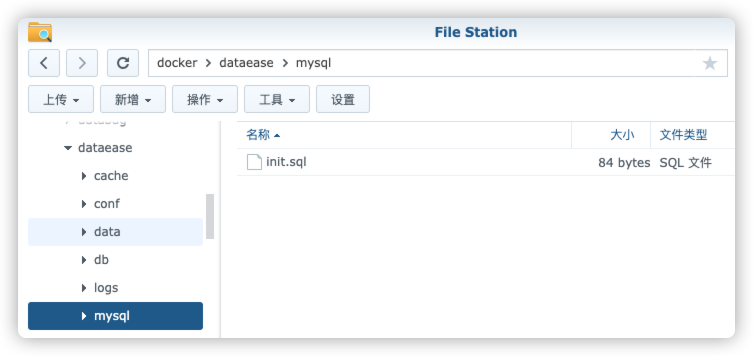

init.sql

内容只有一行,未做任何调整,其作用是:

- 创建了一个名为

dataease的新数据库 - 指定了使用

utf8mb4字符集和utf8mb4_0900_ai_ci排序规则

CREATE DATABASE `dataease` DEFAULT CHARACTER SET utf8mb4 COLLATE utf8mb4_0900_ai_ci;

my.conf

这是数据库的设置文件,未做任何调整

[mysqld]

datadir=/var/lib/mysqldefault-storage-engine=INNODB

character_set_server=utf8

#lower_case_table_names=1

table_open_cache=128

max_connections=2000

max_connect_errors=6000

innodb_file_per_table=1

innodb_buffer_pool_size=1G

max_allowed_packet=64M

transaction_isolation=READ-COMMITTED

innodb_flush_method=O_DIRECT

innodb_lock_wait_timeout=1800

innodb_flush_log_at_trx_commit=0

sync_binlog=0

#group_concat_max_len=1024000

max_allowed_packet=100000000sql_mode=STRICT_TRANS_TABLES,NO_ZERO_IN_DATE,NO_ZERO_DATE,ERROR_FOR_DIVISION_BY_ZERO,NO_ENGINE_SUBSTITUTIONskip-name-resolve[mysql]

default-character-set=utf8[mysql.server]

default-character-set=utf8

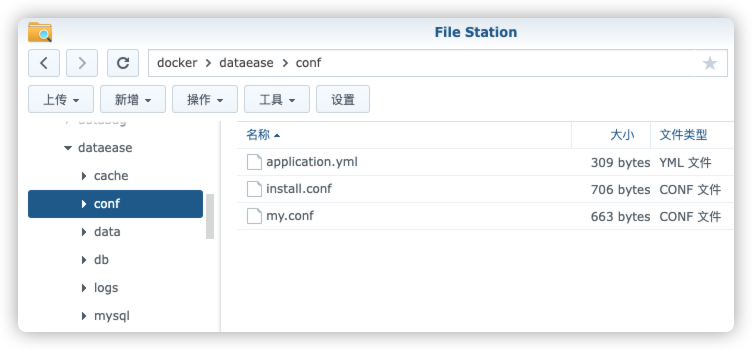

application.yml

这是 DataEase 的设置文件,数据库设置都是从环境变量中读取,对没安装的 apisix 等做了删除处理

server:tomcat:connection-timeout: 70000

spring:servlet:multipart:max-file-size: 500MBmax-request-size: 500MBdatasource:url: jdbc:mysql://${DE_MYSQL_HOST}:${DE_MYSQL_PORT}/${DE_MYSQL_DB}?${DE_MYSQL_PARAMS}username: ${DE_MYSQL_USER}password: ${DE_MYSQL_PASSWORD}

install.conf

这是 DataEase 的环境变量设置文件,建议只修改 DE_MYSQL_PASSWORD 的值,其他的保持不动。

DE_MYSQL_DB 的值,必须和 init.sql 中的数据库名字保持一致

# 基础配置

## 安装目录

DE_BASE=/opt

## Service 端口

DE_PORT=8100

## 登录超时时间,单位min。如果不设置则默认8小时,也就是480

DE_LOGIN_TIMEOUT=480

## 安装模式

DE_INSTALL_MODE=community# 数据库配置

## 是否使用外部数据库

DE_EXTERNAL_MYSQL=false

## 数据库地址

DE_MYSQL_HOST=mysql

## 数据库端口

DE_MYSQL_PORT=3306

## DataEase 数据库库名

DE_MYSQL_DB=dataease

## 数据库用户名

DE_MYSQL_USER=root

## 数据库密码

DE_MYSQL_PASSWORD=123456

## 数据库参数

DE_MYSQL_PARAMS="autoReconnect=false&useUnicode=true&characterEncoding=UTF-8&characterSetResults=UTF-8&zeroDateTimeBehavior=convertToNull&useSSL=false&allowPublicKeyRetrieval=true"

docker-compose.yml

将下面的内容保存为 docker-compose.yml 文件

version: '2.1'services:dataease1:image: registry.cn-qingdao.aliyuncs.com/dataease/dataease:v2.5.0container_name: dataease-appports:- 8100:8100volumes:- ./conf:/opt/apps/config- ./logs:/opt/dataease2.0/logs- ./data/static-resource:/opt/dataease2.0/data/static-resource- ./cache:/opt/dataease2.0/cache- ./data/geo:/opt/dataease2.0/data/geo- ./data/appearance:/opt/dataease2.0/data/appearanceenv_file:- ./conf/install.confdepends_on:- mysqlmysql:image: registry.cn-qingdao.aliyuncs.com/dataease/mysql:8.3.0container_name: dataease-mysql#ports:# - 3306:3306environment:# - MYSQL_DATABASE=dataease- MYSQL_ROOT_PASSWORD=123456volumes:- ./conf/my.conf:/etc/mysql/conf.d/my.cnf- ./mysql:/docker-entrypoint-initdb.d/- ./db:/var/lib/mysql

将文件放入响应的目录中:

docker-compose.yml在/dataease目录

init.sql在/dataease/mysql目录

application.yml、install.conf、my.conf三个文件在/dataease/conf目录

然后执行下面的命令

# 新建文件夹 dataease 和 子目录

mkdir -p /volume1/docker/dataease/{cache,conf,data/{appearance,geo,static-resource},db,logs,mysql}# 进入 dataease 目录

cd /volume1/docker/dataease# 将 docker-compose.yml 放入当前目录

# 将 init.sql 放入 /mysql 目录

# 将 application.yml、install.conf、my.conf 放入 /conf 目录# 一键启动

docker-compose up -d

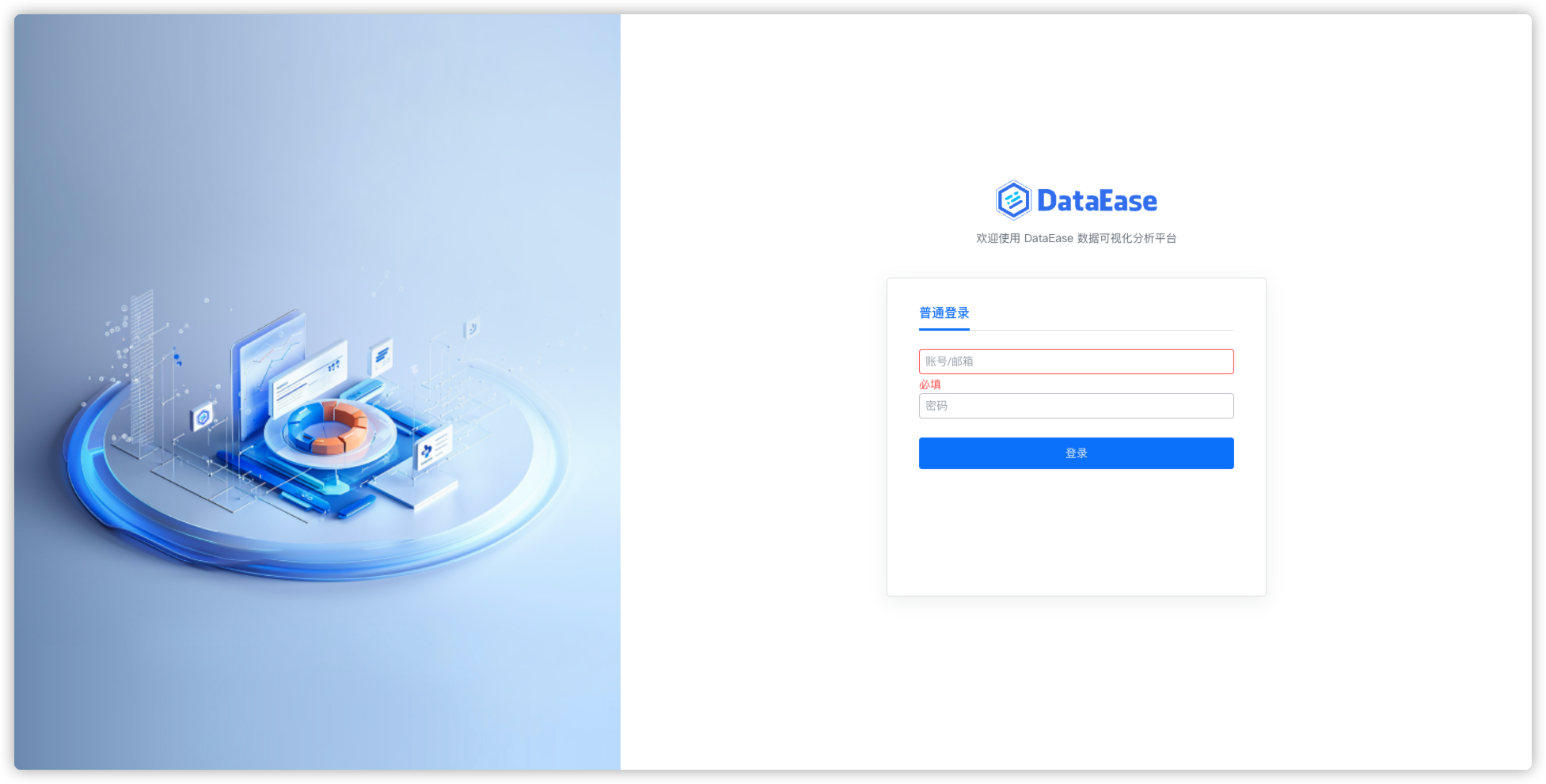

运行

在浏览器中输入 http://群晖IP:8100 就能看到登录界面

# 用户名: admin

# 密码: DataEase@123456

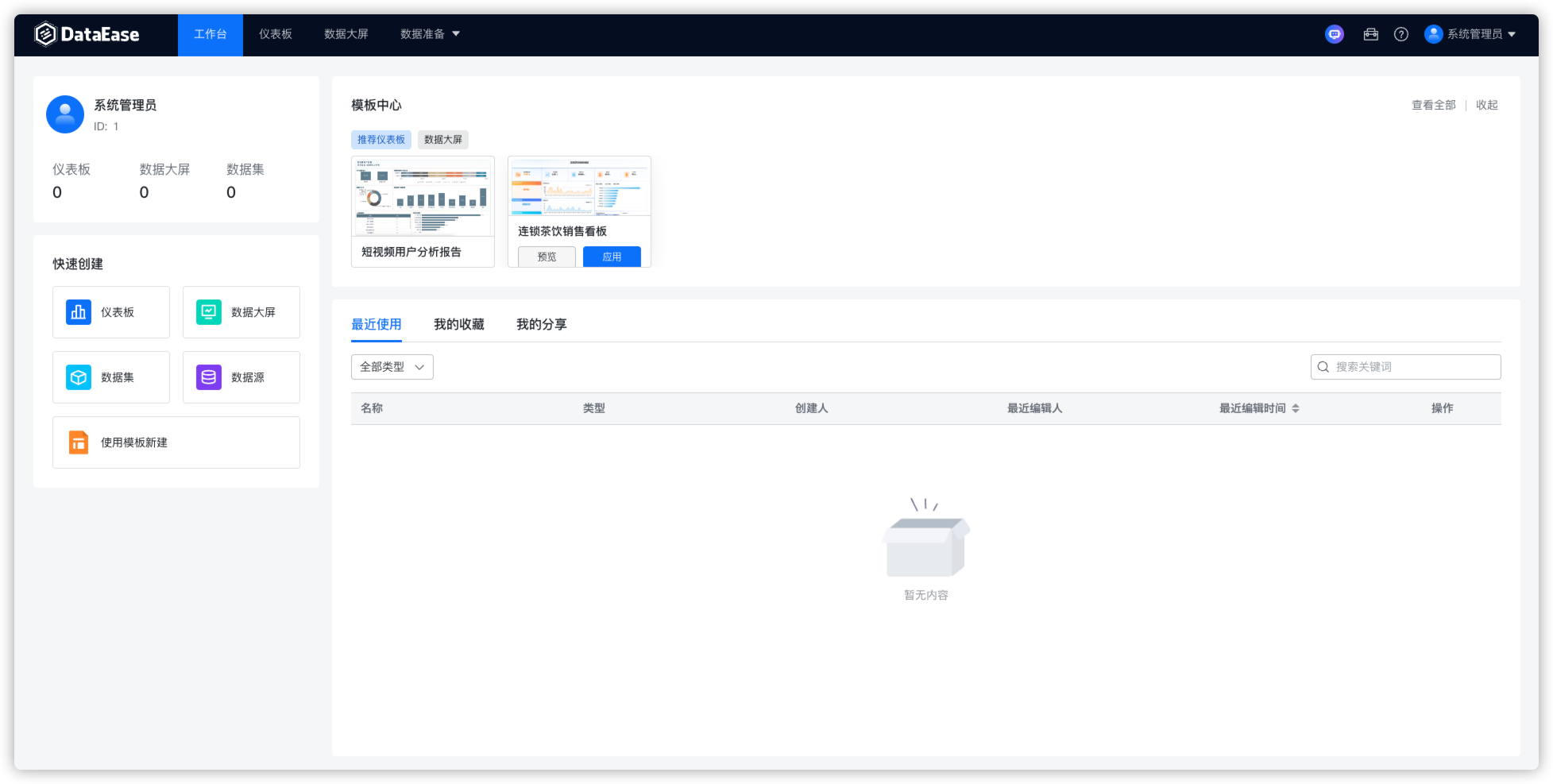

登录成功后的主界面

数据源

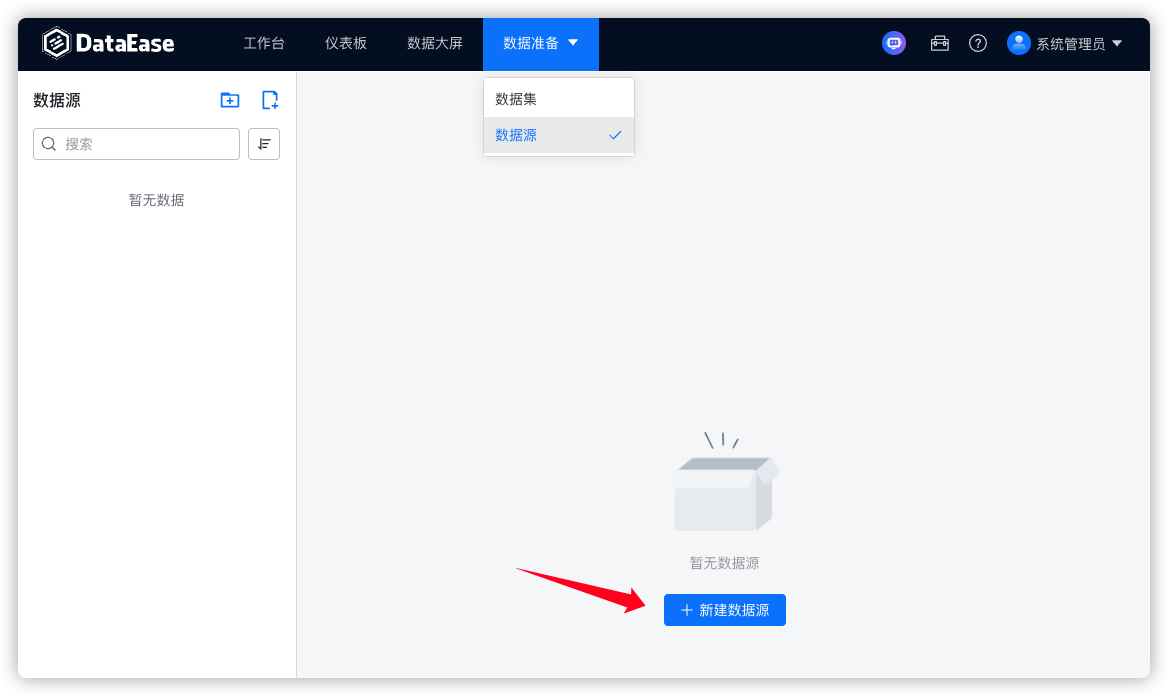

数据准备 --> 数据源 --> 新建数据源

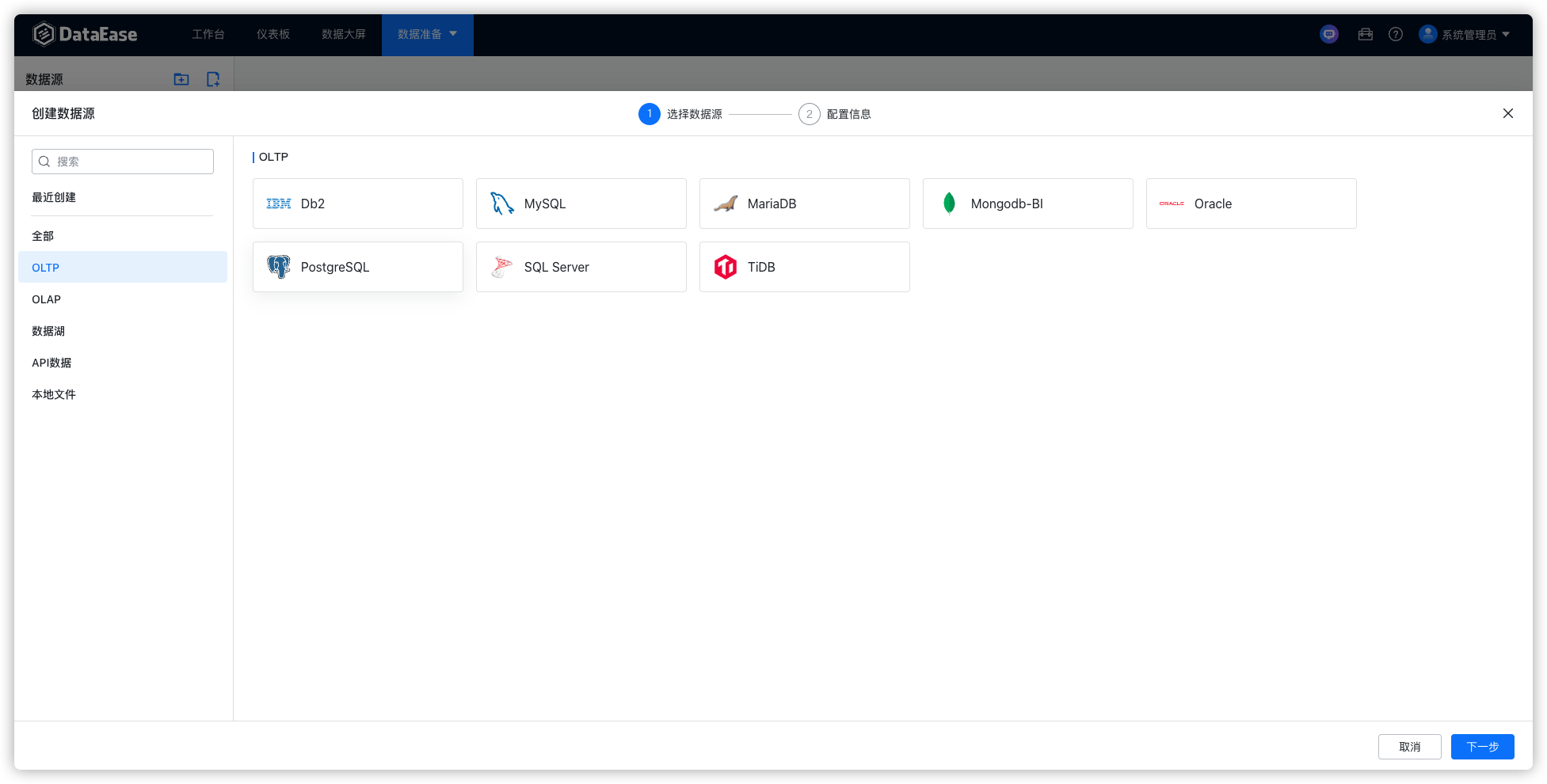

DataEase 支持的数据源:

OLTP数据库:MySQL、Oracle、SQL Server、PostgreSQL、MariaDB、Db2、TiDB、MongoDB-BI等;OLAP数据库:ClickHouse、Apache Doris、Apache Impala、StarRocks等;- 数据仓库/数据湖:

Amazon RedShift等; - 数据文件:

Excel、CSV等; API数据源。

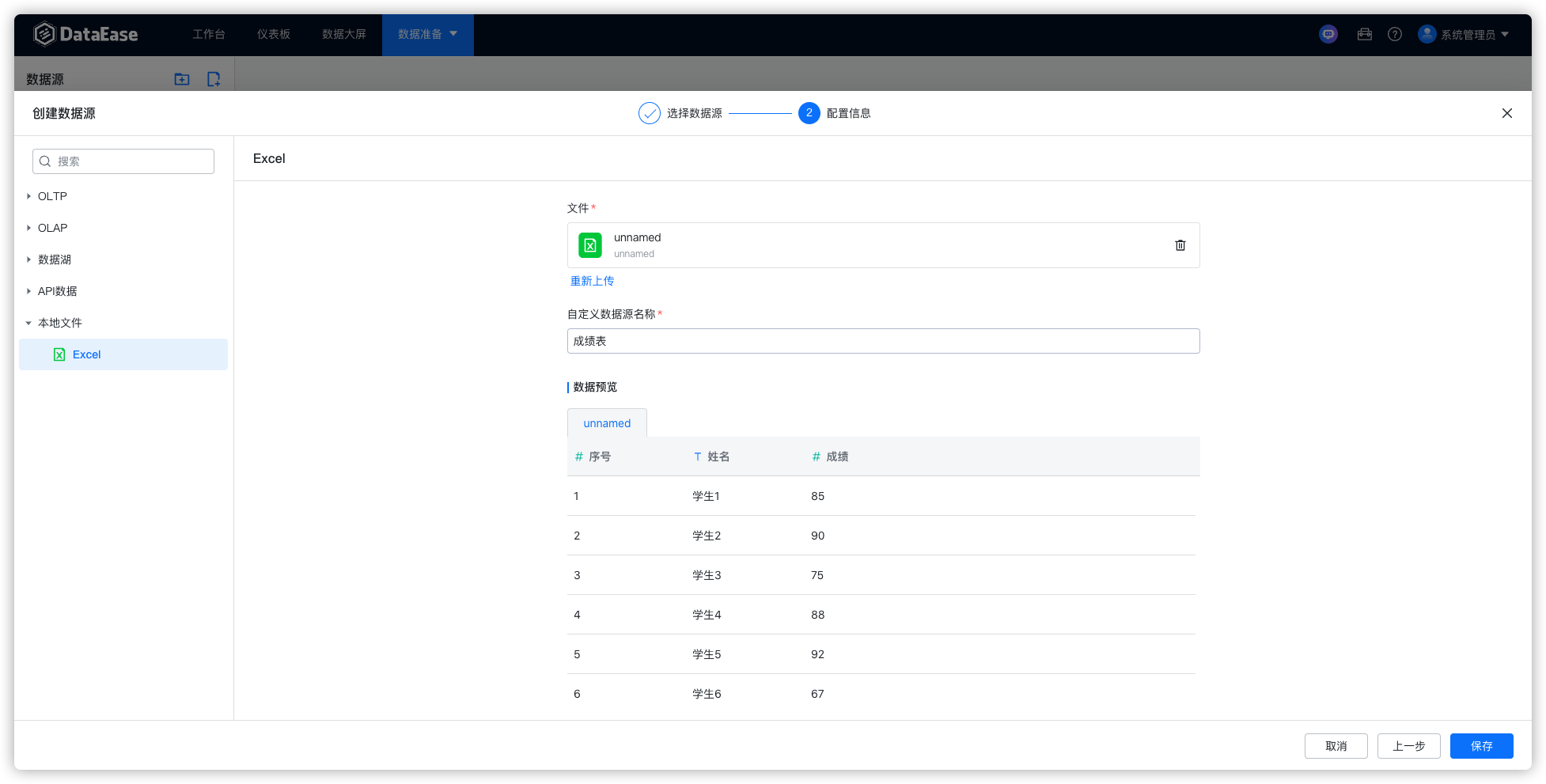

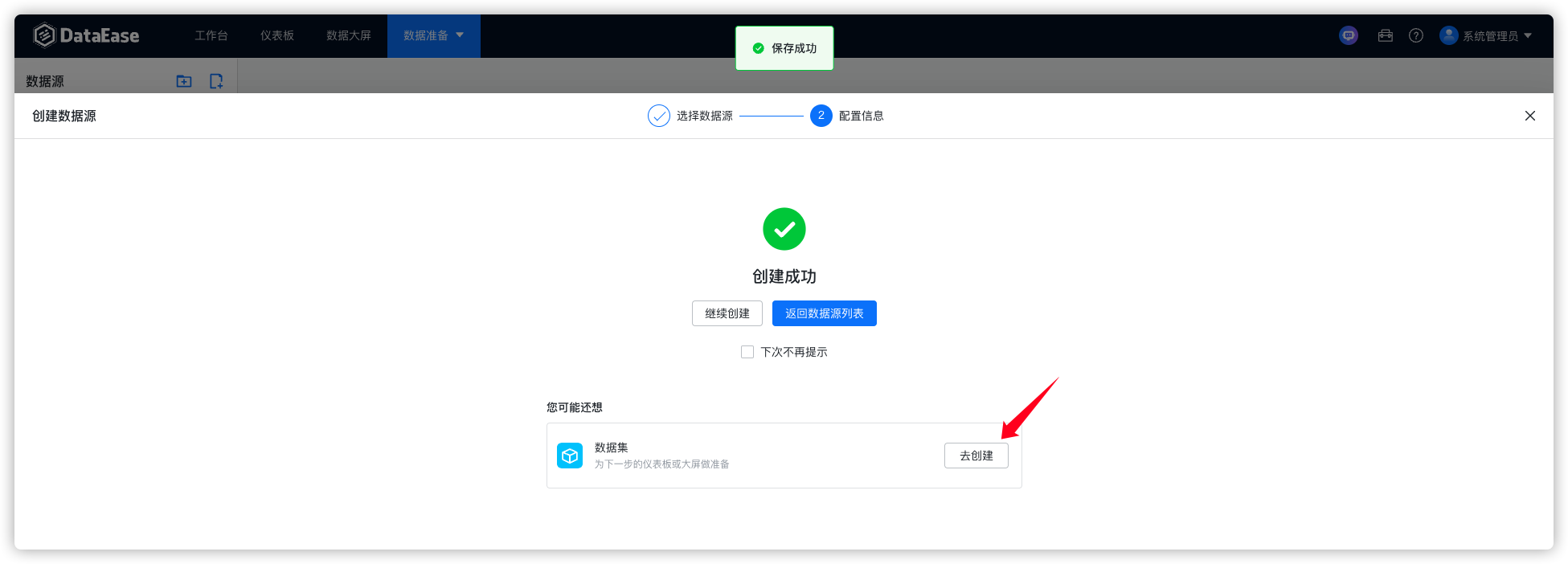

随机生成了一个虚拟的成绩表,格式是 csv,导入保存即可

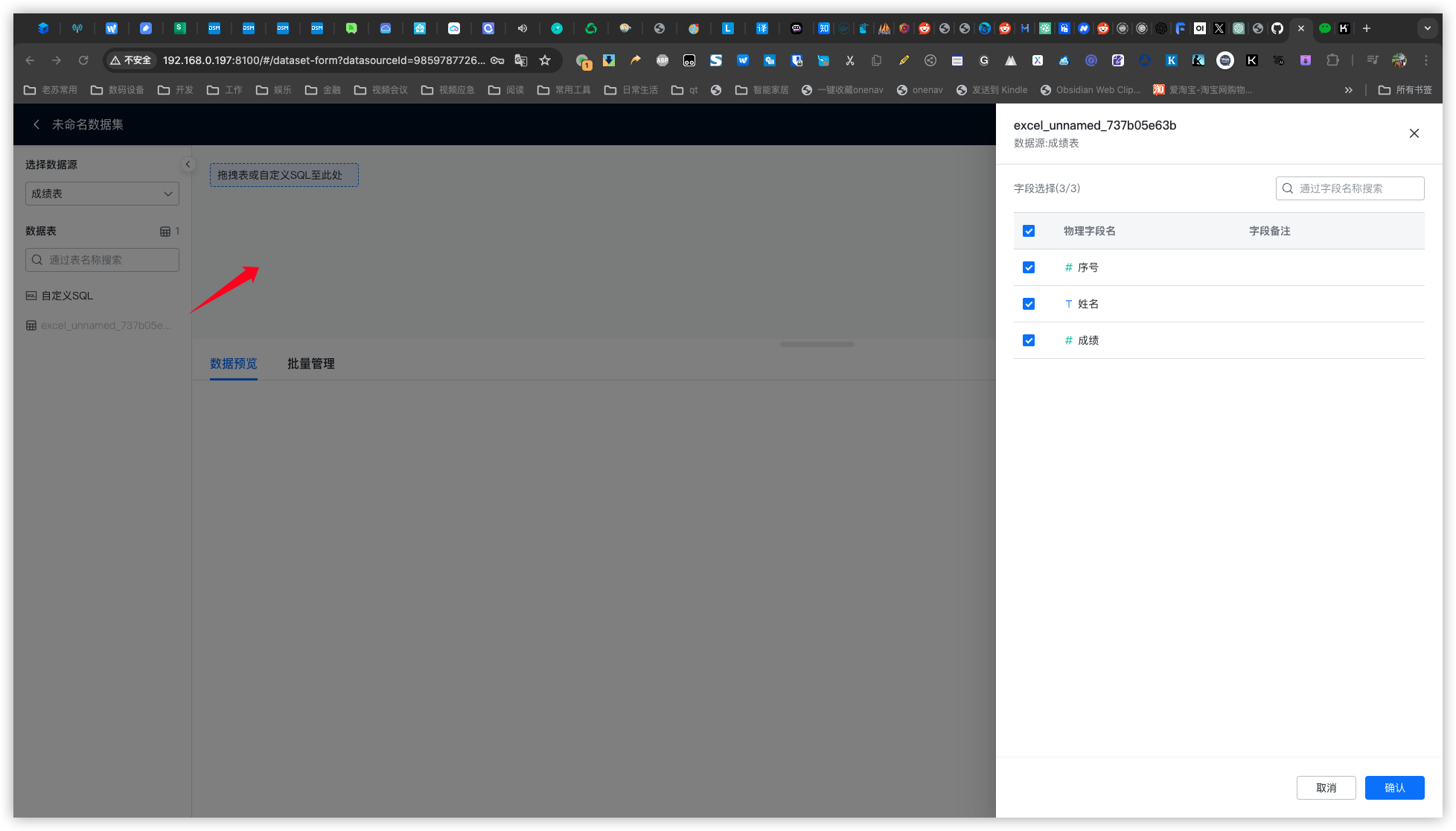

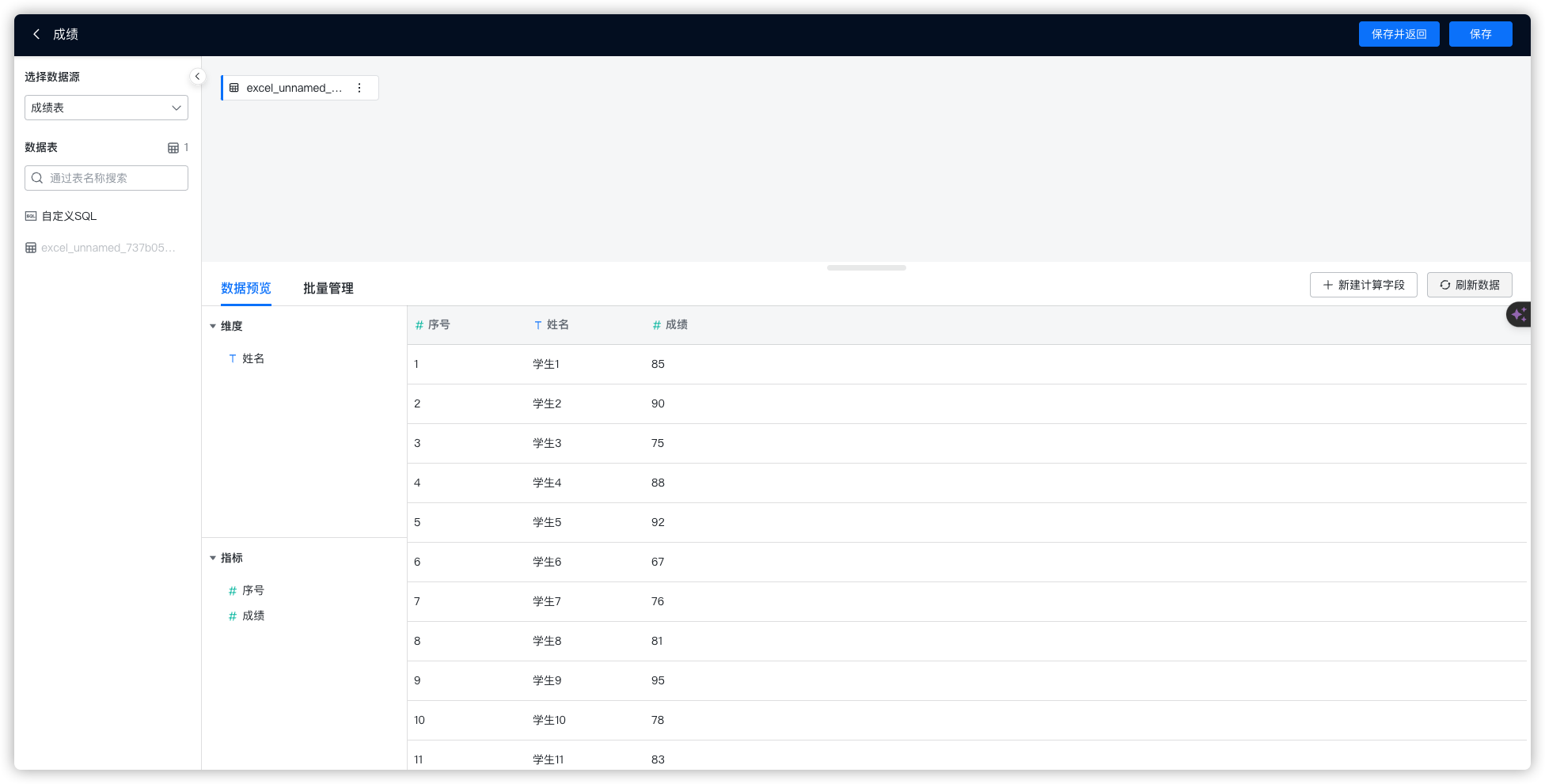

数据集

创建数据集

将数据拖入

直接默认的,保存即可

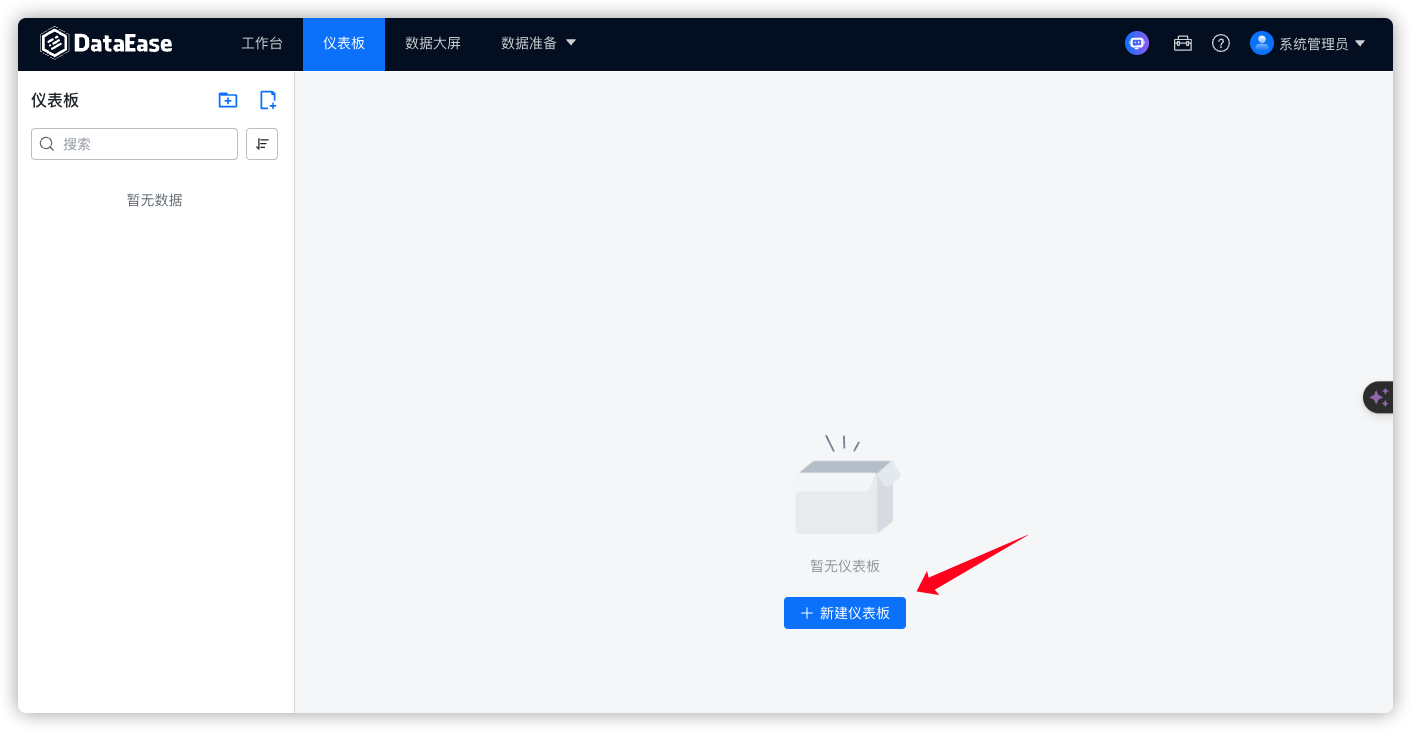

仪表板

新建仪表板

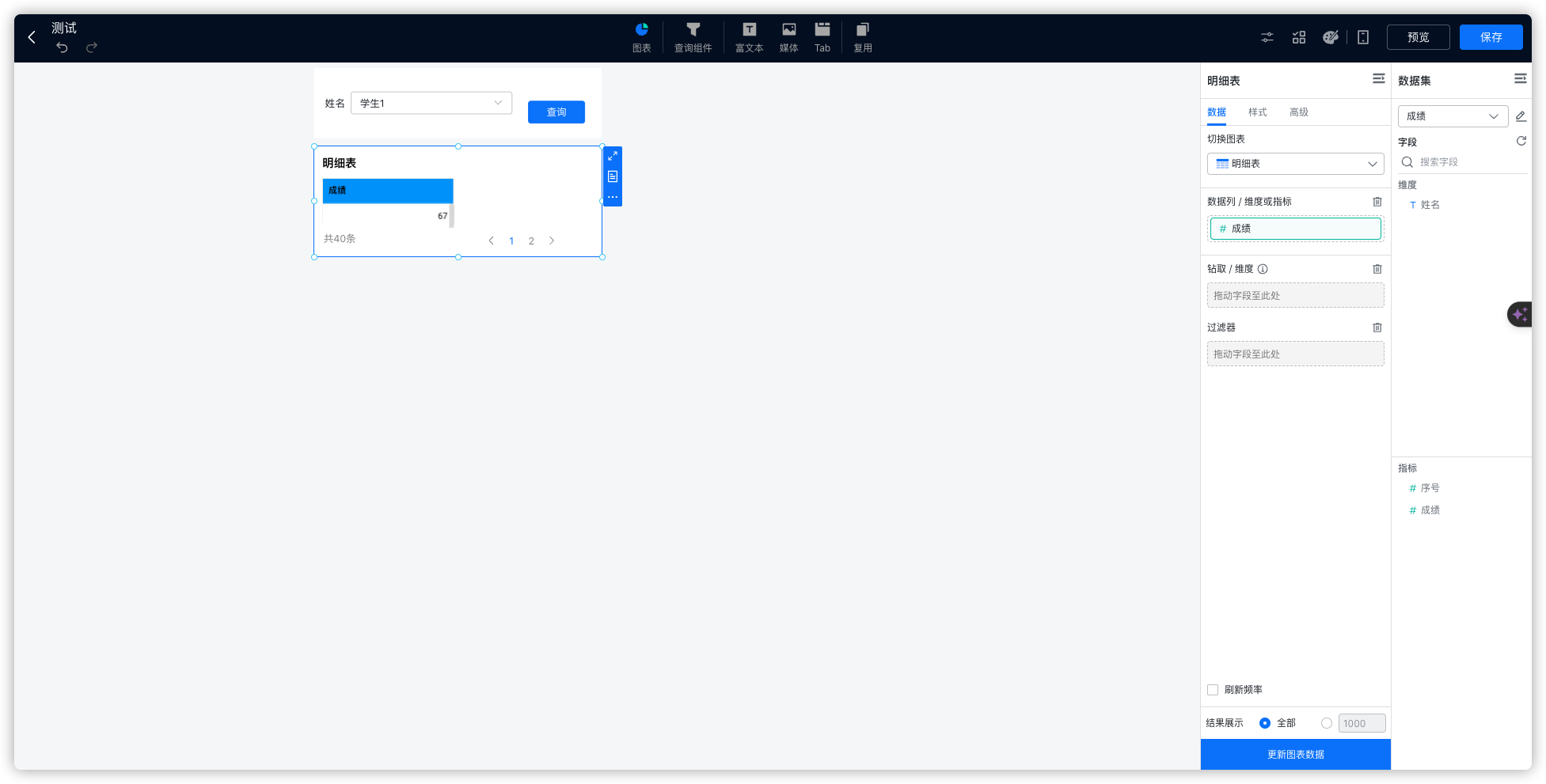

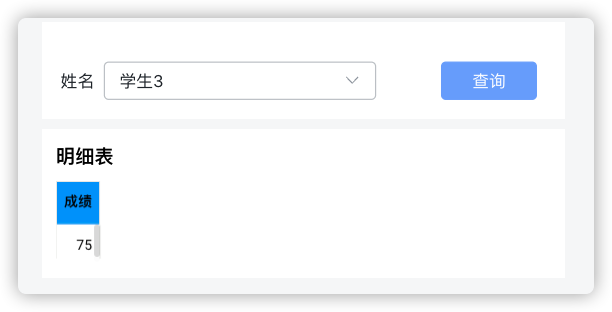

弄了个查询组件和明细表

做了个联动查询

再复杂我也玩不转了,系统内置了大量的模板可供研究

网上也有大量的教程,不仅有图文,还有视频的

参考文档

dataease/dataease: 人人可用的开源数据可视化分析工具。

地址:https://github.com/dataease/dataease

DataEase - 人人可用的开源数据可视化分析工具 - 官网

地址:https://dataease.io/

DataEase 文档

地址:https://dataease.io/docs/

这篇关于数据可视化分析工具DataEase的文章就介绍到这儿,希望我们推荐的文章对编程师们有所帮助!