本文主要是介绍python网页爬虫漫画案例_利用python3爬虫爬取漫画岛-非人哉漫画,希望对大家解决编程问题提供一定的参考价值,需要的开发者们随着小编来一起学习吧!

最近学了一点点python爬虫的知识,面向百度编程爬了一本小说之后感觉有点不满足,于是突发奇想尝试爬一本漫画下来看看。

一、效果展示

网页截图:

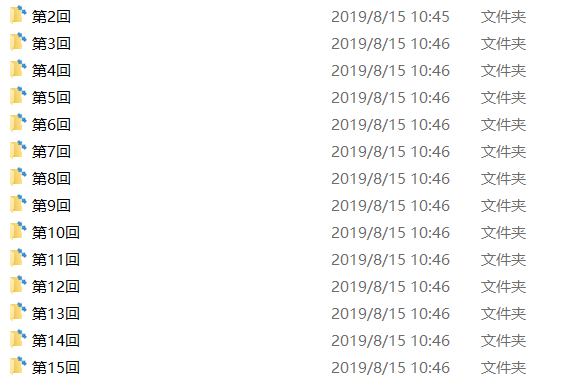

其次是爬取下来的效果:

每一回的文件夹里面是这样的: (因为网站图片的问题...所以就成了这个鬼样子)

二、分析原理

1、准备:需要vscode或者其他能够编译运行python的软件,推荐python版本3.X ,否则有可能出现编译问题。

下载所需模块:win+R 进入命令行, 输入 pip install <模块名> 即可下载。例如:

pip install beautifulsoup4

2、原理: 模拟浏览器点击->打开漫画网页链接->获取网页源码->定位每一章漫画的链接->模拟点击->获取图片页面源码->定位图片链接->下载图片

三、实际操作(代码附在最后)

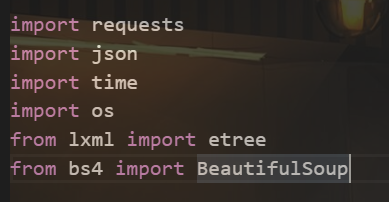

1、引入模块 (这里不再详述)

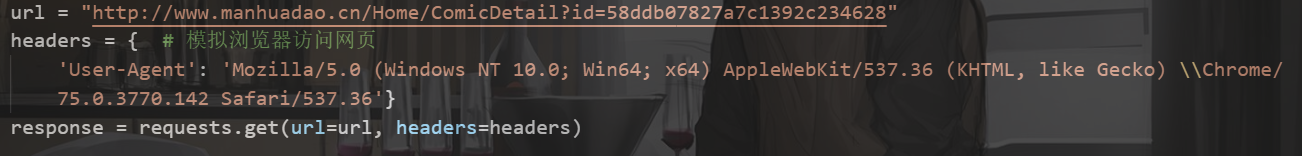

2、模拟浏览器访问网页

(1)、 这里我们打开漫画的目录页,如下: url = ”http://www.manhuadao.cn/Home/ComicDetail?id=58ddb07827a7c1392c234628“ ,此链接就是目录页链接。

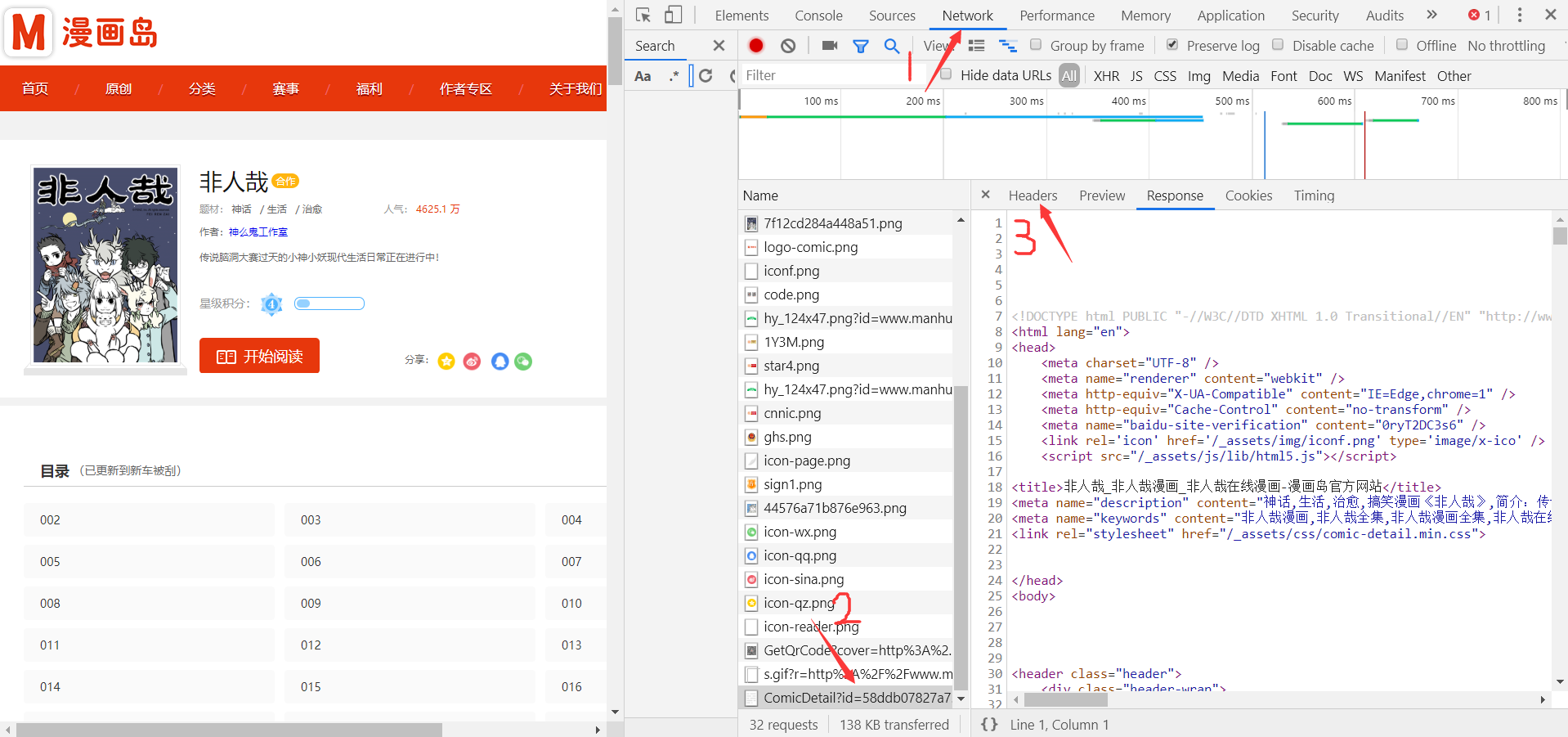

(2)、按F12打开此网页的源码(谷歌浏览器),选中上方NetWork,Ctrl+R刷新。

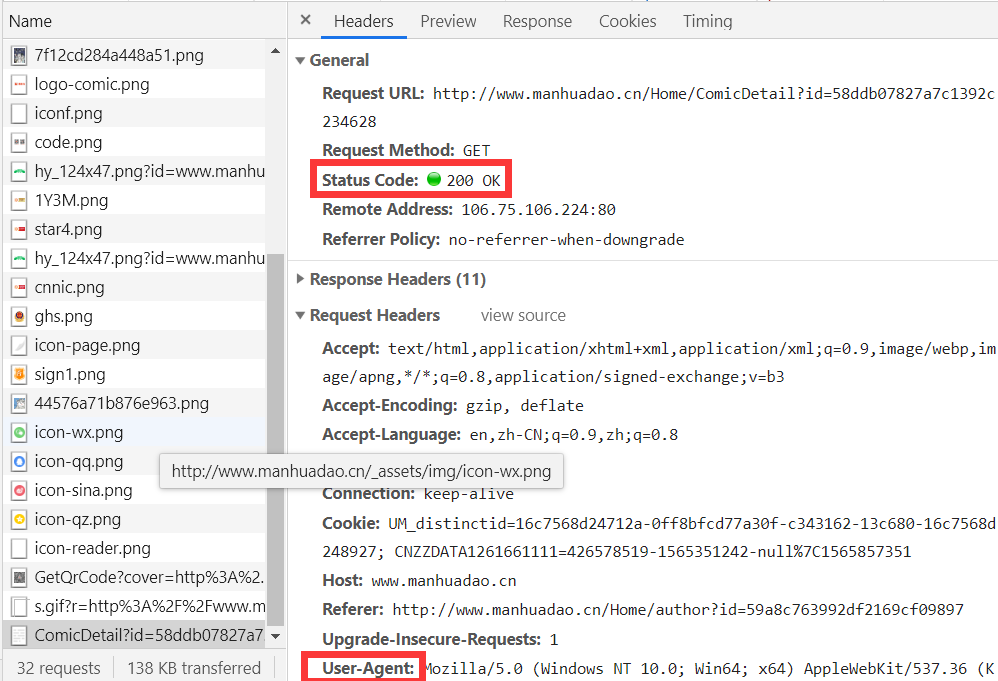

(3)、找到加载网页的源码文件,点击Headers,如下图: Status Code表示网页返回的代码,值为200时表示访问成功。

(4)、headers中的参数为下面红框User-Agent。

response = requests.get(url=url, headers=headers) #模拟访问网页

print(response) #此处应输出

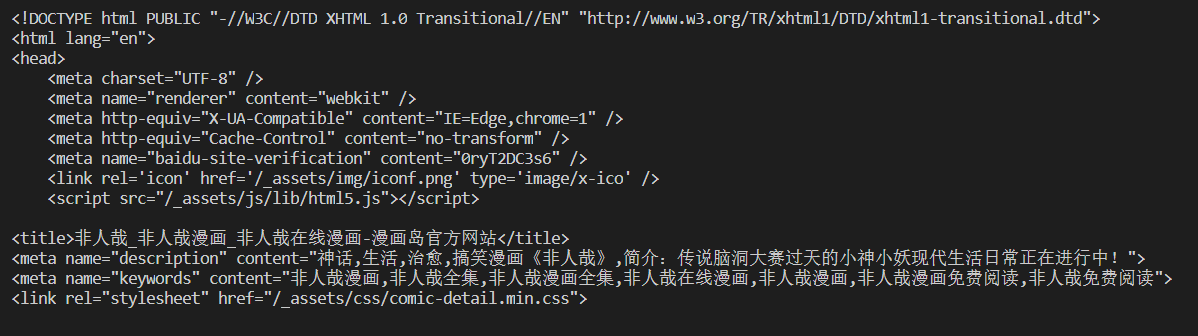

print(response.text) #输出网页源码

两个输出分别输出:

输出返回200表示访问成功。

输出返回200表示访问成功。

(节选)

(节选)

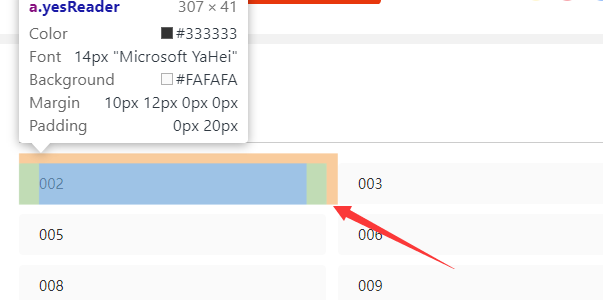

(5)、将html代码存入 data 中,xpath定位每一章链接。点击上方Element,点击:

将鼠标移至目录处:

右边代码区域出现每一章链接:

data =etree.HTML(response.text)#tp = data.xpath('//ul[@class="read-chapter"]/li/a[@class="active"]/@href')

tp = data.xpath('//*[@class="yesReader"]/@href')zhang_list = tp #tp为链接列表

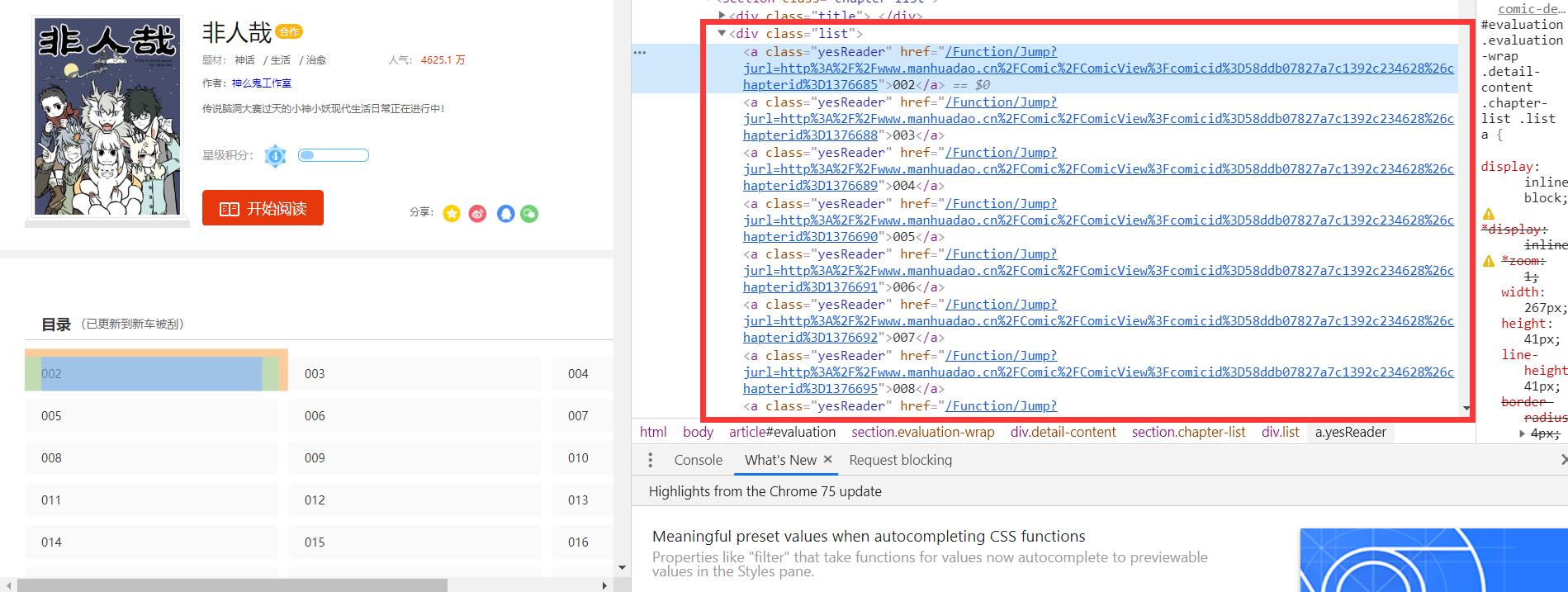

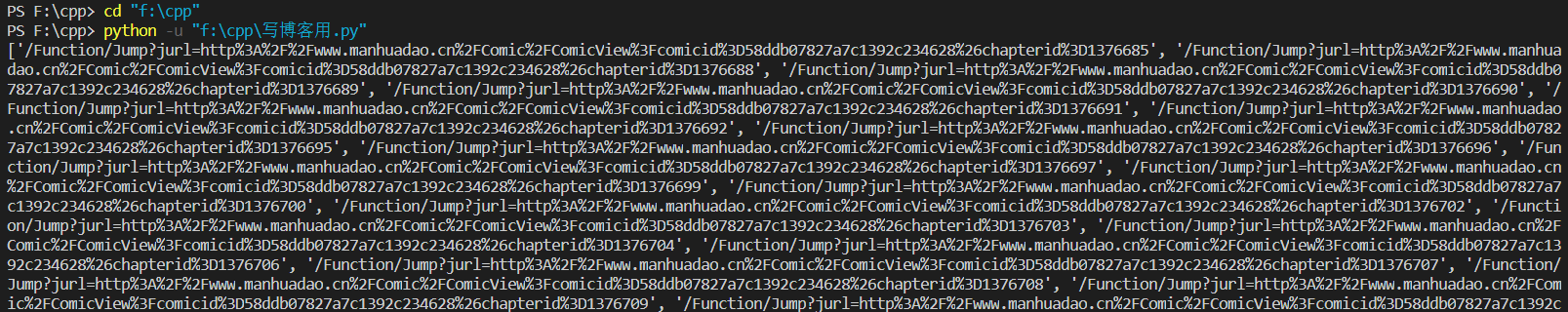

输出zhang_list,结果如下:

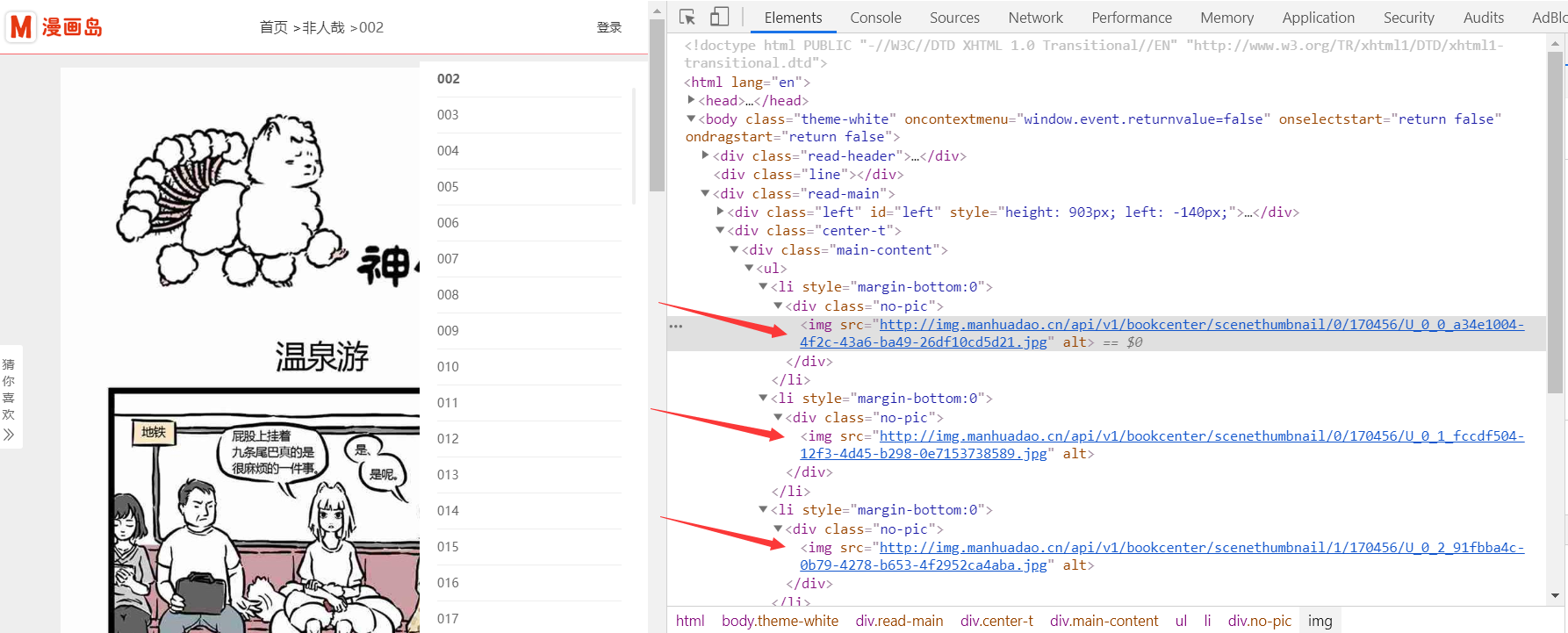

(6)、获取图片链接(获取方式同上一步)

点进第一章,同上一步,寻找到图片链接:

1 i=1

2 for next_zhang inzhang_list: # 在章节列表中循环3 i=i+1

4 j=05 hui_url = r_url+next_zhang6 name1 = "第"+str(i)+"回"

7 file = 'C:/Users/wangyueke/Desktop/'+keyword+'/{}/'.format(name1) # 创建文件夹8 if notos.path.exists(file):9 os.makedirs(file)10 print('创建文件夹:', file)11 response = requests.get(url=hui_url, headers=headers) # 模拟访问每一章链接12 data =etree.HTML(response.text)13 #tp = data.xpath('//div[@class="no-pic"]//img/@src')

14 tp = data.xpath('//div[@class="main-content"]//ul//li//div[@class="no-pic"]//img/@src') # 定位15 ye_list = tp

(7)、下载图片

1 for k in ye_list: #在每一章的图片链接列表中循环

2 download_url =tp[j]3 print(download_url)4 j=j+1

5 file_name="第"+str(j)+"页"

6 response = requests.get(url=download_url) #模拟访问图片链接

7 with open(file+file_name+".jpg","wb") as f:8 f.write(response.content)

五、代码

1 '''

2 用于爬取非人哉漫画3 目标网址:http://www.manhuadao.cn/4 开始时间:2019/8/14 20:01:265 完成时间:2019/8/15 11:04:566 作者:kong_gu7 '''

8 importrequests9 importjson10 importtime11 importos12 from lxml importetree13 from bs4 importBeautifulSoup14

15

16 defmain():17 keyword="非人哉"

18 file = 'E:/{}'.format(keyword)19 if notos.path.exists(file):20 os.mkdir(file)21 print('创建文件夹:',file)22 r_url="http://www.manhuadao.cn/"

23 url = "http://www.manhuadao.cn/Home/ComicDetail?id=58ddb07827a7c1392c234628"

24 headers = { #模拟浏览器访问网页

25 'User-Agent': 'Mozilla/5.0 (Windows NT 10.0; Win64; x64) AppleWebKit/537.36 (KHTML, like Gecko) \\Chrome/75.0.3770.142 Safari/537.36'}26 response = requests.get(url=url, headers=headers)27 #print(response.text) # 输出网页源码

28 data =etree.HTML(response.text)29 #tp = data.xpath('//ul[@class="read-chapter"]/li/a[@class="active"]/@href')

30 tp = data.xpath('//*[@class="yesReader"]/@href')31 zhang_list =tp32 i=1

33 for next_zhang inzhang_list:34 i=i+1

35 j=036 hui_url = r_url+next_zhang37 name1 = "第"+str(i)+"回"

38 file = 'C:/Users/wangyueke/Desktop/'+keyword+'/{}/'.format(name1) #这里需要自己设置路径

39 if notos.path.exists(file):40 os.makedirs(file)41 print('创建文件夹:', file)42 response = requests.get(url=hui_url, headers=headers)43 data =etree.HTML(response.text)44 #tp = data.xpath('//div[@class="no-pic"]//img/@src')

45 tp = data.xpath('//div[@class="main-content"]//ul//li//div[@class="no-pic"]//img/@src')46 ye_list =tp47 for k inye_list:48 download_url =tp[j]49 print(download_url)50 j=j+1

51 file_name="第"+str(j)+"页"

52 response = requests.get(url=download_url)53 with open(file+file_name+".jpg","wb") as f:54 f.write(response.content)55

56

57 if __name__ == '__main__':58 main()

第一次写博客,如果有写的不对的地方,请大佬指正,谢谢!_(:з」∠)_

这篇关于python网页爬虫漫画案例_利用python3爬虫爬取漫画岛-非人哉漫画的文章就介绍到这儿,希望我们推荐的文章对编程师们有所帮助!