本文主要是介绍CV每日论文--2024.6.11,希望对大家解决编程问题提供一定的参考价值,需要的开发者们随着小编来一起学习吧!

1、GaussianCity: Generative Gaussian Splatting for Unbounded 3D City Generation

中文标题:GaussianCity:生成无界 3D 城市的生成高斯泼溅

简介:这篇论文提出了一种名为"GaussianCity"的高效3D城市生成框架,解决了基于NeRF的方法和3D高斯喷洒(3D-GS)在无限尺度3D城市生成方面的局限性。

主要创新点如下:

紧凑的3D场景表示:引入BEV-Point作为高度压缩的中间表示,确保无限场景的VRAM使用量保持恒定,从而实现无限城市生成。

空间感知的高斯属性解码器:提出了空间感知的BEV-Point解码器,利用点序列化器集成BEV点的结构和上下文特征,产生高质量的3D高斯属性。

与基于NeRF的方法相比,GaussianCity大幅提高了计算效率。同时,与直接应用3D-GS于大规模城市场景相比,GaussianCity通过紧凑的场景表示和空间感知解码器,克服了内存不足的问题,可以高效合成无限的3D城市。

广泛的实验表明,GaussianCity在无人机视角和街景视角下的3D城市生成都取得了最先进的结果。与最近提出的CityDreamer方法相比,GaussianCity的生成速度提高了60倍,达到了10.72 FPS的实时性能。

总之,GaussianCity通过创新的3D场景表示和解码策略,有效解决了大规模3D城市生成的计算效率和内存限制问题,为城市可视化、游戏、仿真等应用提供了重要的技术支撑

2、IllumiNeRF: 3D Relighting without Inverse Rendering

中文标题:IlumiNeRF:无需逆向渲染的 3D 重新照明

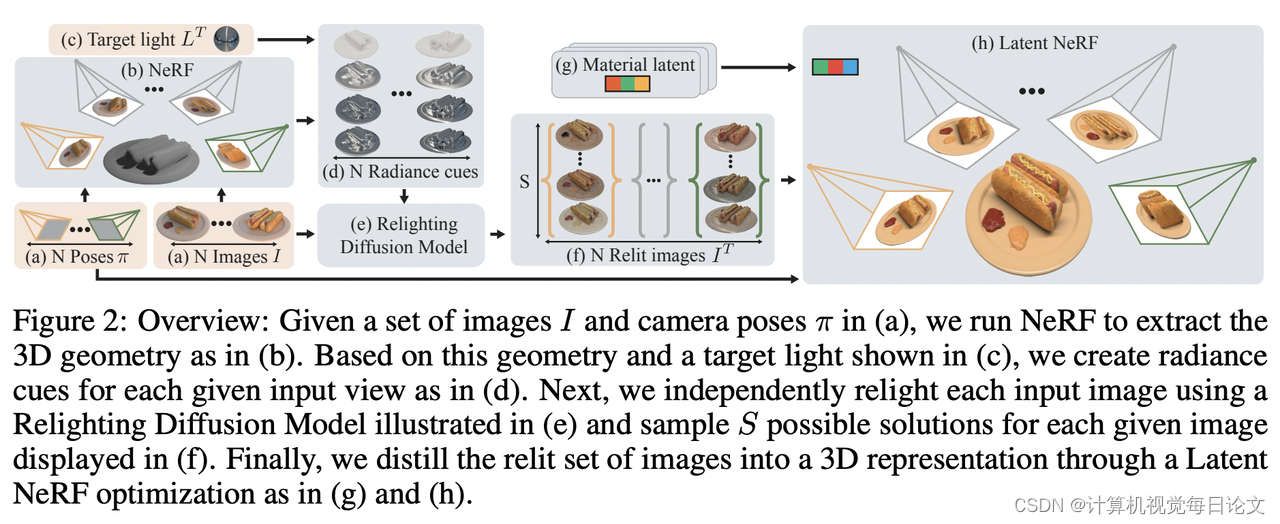

简介:这篇论文提出了一种新的可重光视图合成方法,摆脱了传统基于反向渲染的方法,而是采用更简单高效的策略。

当前的可重光视图合成方法通常基于反向渲染,试图从输入图像中解开物体几何、材质和光照因素,并通过可微分蒙特卡罗渲染进行优化。这种方法计算成本高昂,容易出错。

为了解决这一问题,本文提出了一种新方法:

1. 首先使用一个以光照为条件的图像扩散模型,对每个输入图像进行重新照明。

2. 然后利用这些重新照明的图像,重建一个神经辐射场(NeRF)。

3. 最后从重建的NeRF中渲染出目标照明下的新视角图像。

作者证明了这种基于扩散模型的策略出奇地有竞争力,在多个重照基准测试中实现了最先进的性能。与传统的基于反向渲染的方法相比,该方法计算简单高效,避免了可微分渲染优化过程中的错误。

总的来说,这项工作提出了一种全新的可重光视图合成方法,通过利用图像扩散模型实现了更加优雅和高效的解决方案,为相关领域带来了重要进展。感兴趣的读者可以访问项目页面https://illuminerf.github.io/了解更多详情。

3、NaRCan: Natural Refined Canonical Image with Integration of Diffusion Prior for Video Editing

中文标题:NaRCan:自然精致的规范图像与扩散先验的集成用于视频编辑

简介:通过整合混合变形场和扩散先验,生成高质量的自然规范图像来代表输入视频。

主要创新点如下:

1. 利用单应性建模全局运动,并采用多层感知器(MLPs)捕捉局部残差变形,增强模型处理复杂视频动态的能力。

2. 在训练的早期引入扩散先验,确保生成的规范图像保持高质量的自然外观,适用于视频编辑中的各种下游任务,这是当前基于规范的方法所无法实现的。

3. 结合低秩适应(LoRA)微调,并引入噪声和扩散先验更新调度技术,将训练过程加速了14倍。

广泛的实验结果表明,NaRCan在各种视频编辑任务中均优于现有方法,生成了连贯和高质量的编辑视频序列。

与传统基于规范的方法相比,NaRCan通过混合变形场和扩散先验的独特设计,确保生成的规范图像保持自然外观,同时大幅提高了训练效率。这为视频编辑、合成等应用提供了重要的技术支撑。

感兴趣的读者可以访问项目页面https://koi953215.github.io/NaRCan_page/查看视频结果,了解NaRCan的更多细节。精致的规范图像与扩散先验的集成用于视频编辑

简介:

这篇关于CV每日论文--2024.6.11的文章就介绍到这儿,希望我们推荐的文章对编程师们有所帮助!